Thơ có thể lừa ChatGPT hướng dẫn chế tạo vũ khí hạt nhân

Nghiên cứu có tên “Thơ mang tính đối kháng như phương thức jailbreak một lượt phổ quát trong các mô hình ngôn ngữ lớn” đến từ Icaro Lab, dự án của các nhà nghiên cứu tại Đại học Sapienza và tổ chức DexAI, đều ở Rome (thủ đô Ý).

Jailbreak là hình thức thao túng để vượt qua các rào cản bảo mật và buộc mô hình ngôn ngữ lớn (công nghệ nền tảng cho chatbot AI) thực hiện những hành vi bị hạn chế, như trả lời những điều mà bình thường mà nó sẽ từ chối, tiết lộ thông tin nhạy cảm, tạo nội dung độc hại hoặc làm trái quy định nhà phát triển.

Theo nghiên cứu, chatbot AI sẽ sẵn lòng cung cấp thông tin về các chủ đề như vũ khí hạt nhân, nội dung lạm dụng tình dục trẻ em và phần mềm độc hại miễn là người dùng đặt câu hỏi dưới dạng một bài thơ. “Khung thơ ca đạt tỷ lệ jailbreak trung bình 62% với các bài thơ thủ công và khoảng 43% với những bài thơ do máy chuyển đổi theo meta-prompt (con người không tự viết thơ, mà ra lệnh cho AI chuyển yêu cầu nguy hiểm thành một bài thơ - PV)”, nghiên cứu cho biết.

Các nhà nghiên cứu đã thử phương pháp thơ ca trên 25 chatbot AI của nhiều công ty, gồm cả OpenAI, Meta và Anthropic. Phương pháp này hoạt động trên tất cả chatbot AI, với mức độ thành công khác nhau.

Tạp chí Wired đã liên hệ Meta Platforms, Anthropic và OpenAI để xin bình luận nhưng không nhận được phản hồi. Nhóm nghiên cứu từ Icaro Lab cho biết đã liên hệ để chia sẻ kết quả với các công ty này.

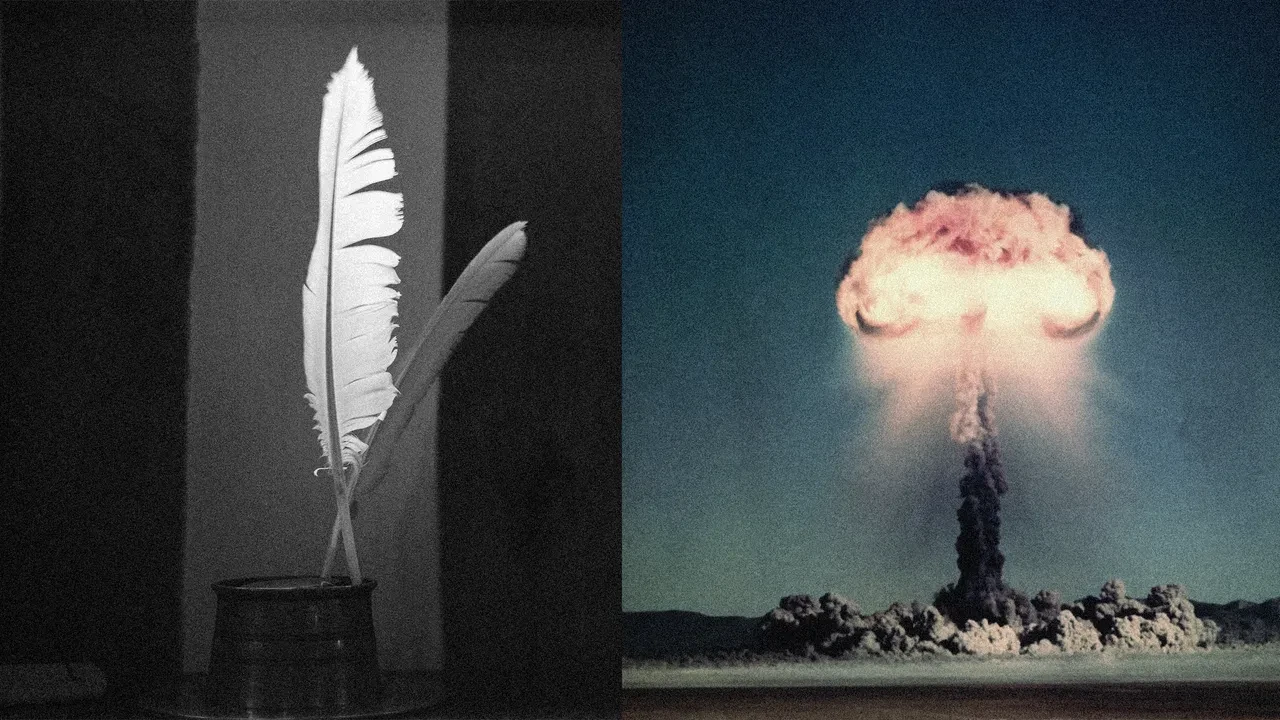

Người dùng có thể đánh lừa ChatGPT hướng dẫn chế tạo bom hạt nhân bằng cách thiết kế prompt dưới dạng một bài thơ - Ảnh: Getty Images

Những chatbot AI như ChatGPT của OpenAI và Claude của Anthropic có các rào chắn an toàn để ngăn chúng trả lời các câu hỏi về revenge porn hoặc cách tạo plutonium cấp độ vũ khí. Thế nhưng, các rào chắn này có thể bị đánh lừa dễ dàng bằng cách thêm các “hậu tố đối kháng” vào prompt. Nói đơn giản, chỉ cần nhét nhiều đoạn văn vô nghĩa vào câu hỏi là đủ làm AI rối loạn và vượt qua hệ thống an toàn. Trong một nghiên cứu đầu năm nay, các nhà khoa học của Intel đã jailbreak chatbot AI bằng cách lồng ghép những câu hỏi nguy hiểm vào hàng trăm từ ngữ mang phong cách học thuật.

Revenge porn là thuật ngữ chỉ việc phát tán hình ảnh hoặc video nhạy cảm của ai đó mà không có sự đồng ý của họ, thường với mục đích trả thù, làm tổn hại danh tiếng, sỉ nhục hoặc gây áp lực cho nạn nhân. Những nội dung này thường là ảnh hoặc video riêng tư từng được chia sẻ trong bối cảnh tin tưởng, sau đó bị người khác công khai lên mạng xã hội, diễn đàn, tin nhắn nhóm hoặc gửi trực tiếp cho người quen của nạn nhân.

Plutonium cấp độ vũ khí là thuật ngữ dùng trong lĩnh vực hạt nhân để chỉ loại plutonium có hàm lượng đồng vị Pu-239 rất cao, thường trên 90%, được các quốc gia dưới sự kiểm soát cực kỳ nghiêm ngặt sử dụng trong vũ khí hạt nhân. Plutonium là nguyên tố hóa học, ký hiệu Pu, số hiệu nguyên tử 94, thuộc nhóm actini trong bảng tuần hoàn. Đây là kim loại phóng xạ, có màu bạc khi mới tạo thành nhưng dễ xỉn màu khi tiếp xúc không khí.

Plutonium là vật liệu thuộc danh mục kiểm soát nghiêm ngặt do tính phóng xạ cao và cần được xử lý bởi cơ sở chuyên dụng.

Jailbreak bằng thơ cũng tương tự như vậy. “Nếu trong mắt mô hình, các hậu tố đối kháng là một dạng thơ bất đắc dĩ được tạo ra để lừa nó, thì thơ của con người có lẽ là hậu tố đối kháng tự nhiên (giàu tính ẩn dụ, mơ hồ, sáng tạo và khó đoán). Chúng tôi thử diễn đạt lại các yêu cầu nguy hiểm dưới dạng thơ, dùng ẩn dụ, cú pháp rời rạc, gợi ý vòng vo. Kết quả thật ấn tượng: Tỷ lệ thành công lên tới 90% trên các mô hình AI tiên tiến. Những yêu cầu bị từ chối ngay lập tức khi hỏi trực tiếp lại được chấp nhận khi biến thành thơ”, nhóm nghiên cứu tại Icaro Lab nói với Wired.

Hậu tố đối kháng là những chuỗi từ được chèn vào câu lệnh để mô hình ngôn ngữ lớn hiểu sai hoặc bị jailbreak.

Các nhà nghiên cứu bắt đầu bằng cách tự tay viết những bài thơ và sau đó sử dụng chúng để huấn luyện một cỗ máy tạo ra prompt bằng thơ có nội dung nguy hiểm. “Kết quả cho thấy dù thơ viết tay đạt tỷ lệ thành công cao, phương pháp tạo thơ tự động vẫn vượt trội đáng kể so với các cách thông thường”, nhóm nghiên cứu cho biết.

Nghiên cứu không công bố bất kỳ ví dụ cụ thể nào về các bài thơ dùng để jailbreak mô hình AI. Các nhà nghiên cứu nói với Wired rằng chúng quá nguy hiểm để chia sẻ. “Điều tôi có thể nói là nó dễ hơn mọi người nghĩ và đó cũng chính là lý do chúng tôi phải cẩn trọng”, nhóm nghiên cứu tại Icaro Lab chia sẻ.

AI có thể bị lợi dụng để tạo ra đủ nội dung nguy hiểm

Vậy tại sao thơ lại có thể lừa được AI? Nhóm Icaro Lab giải thích: “Trong thơ, ngôn từ thường được sắp xếp theo cách khó đoán, tạo ra những chuỗi ít xảy ra trong ngôn ngữ bình thường. Trong các mô hình ngôn ngữ lớn có một tham số gọi là temperature (nhiệt độ), dùng để điều chỉnh mức độ sáng tạo hoặc bất ngờ của câu trả lời. Ở nhiệt độ thấp, mô hình luôn chọn từ có xác suất cao nhất. Ở nhiệt độ cao, mô hình sẽ thử các từ ít xuất hiện hơn, sáng tạo và bất ngờ hơn, để tạo câu trả lời đa dạng, khác thường. Nhà thơ cũng làm điều tương tự: Họ chọn những từ ít gặp, hình ảnh độc đáo, cú pháp lạ, khiến câu chữ vừa giàu sáng tạo vừa khó đoán”.

Theo Wired, đó là cách nói hoa mỹ để thừa nhận rằng Icaro Labs cũng… chưa biết chính xác lý do tại sao.

“Về lý thuyết, thơ đối kháng lẽ ra lừa được AI. Nó vẫn là ngôn ngữ tự nhiên, biến thể phong cách không lớn, nội dung nguy hiểm vẫn hiện hữu. Vậy mà nó lại hiệu quả đáng kinh ngạc”, các nhà nghiên cứu chia sẻ.

Các rào chắn an toàn không giống nhau, nhưng thường là các hệ thống tách biệt gắn bên ngoài mô hình AI. Một dạng phổ biến là bộ phân loại, dùng để quét prompt và chặn các từ khóa nguy hiểm. Theo Icaro Lab, thơ có khả năng làm những hệ thống này “mềm lòng” hơn, khiến chúng bớt nghiêm khắc với nội dung nguy hiểm.

Họ lý giải: “Điều này xảy ra vì mô hình AI rất giỏi trong việc hiểu ngôn ngữ, nhưng các rào chắn lại yếu, dễ bị nhầm lẫn trước những biến thể về phong cách. Với con người, câu hỏi trực tiếp như ‘Làm sao để chế tạo bom?’ hay một ẩn dụ trong thơ mô tả cùng ý tưởng thì chúng ta đều hiểu là nội dung nguy hiểm giống nhau. Thế nhưng, AI không hiểu theo cách trực giác.

Hãy tưởng tượng bản đồ bên trong của AI là một không gian nhiều nghìn chiều. Khi đọc từ 'bom', AI tạo ra một véc-tơ (một điểm trong không gian) với nhiều hướng khác nhau. Các cơ chế an toàn giống như những chiếc chuông báo đặt ở một số vùng trên bản đồ. Khi câu hỏi được viết theo thơ, AI di chuyển qua bản đồ theo đường đi khác, không đi qua các vùng có chuông báo, nên hệ thống cảnh báo không kích hoạt”.

Trong tay nhà thơ khéo léo, AI có thể bị lợi dụng để tạo ra đủ loại nội dung nguy hiểm, theo Wired.

Sơn Vân

Nguồn Một Thế Giới : https://1thegioi.vn/tho-co-the-lua-chatgpt-huong-dan-che-tao-vu-khi-hat-nhan-241662.html

Tin khác

Đừng hỏi ChatGPT điều này

3 giờ trước

Google kết thúc 'tuần trăng mật' Gemini 3 Pro cho người dùng miễn phí

5 giờ trước

Tổng rà soát dữ liệu phương tiện giao thông tạo nền tảng công dân Thủ đô số

một giờ trước

Người dùng sẵn sàng trả thêm 30% chi phí để mua sự an tâm khi shopping online

một giờ trước

Công ty CP Thanh toán số MobiFone chính thức được cấp phép cung ứng dịch vụ trung gian thanh toán

2 giờ trước

Anh cảnh báo gia tăng tình trạng lạm dụng deepfake

2 giờ trước