1,2 triệu trẻ em trên thế giới đã bị lạm dụng hình ảnh thông qua AI

Cần bảo vệ trẻ em trước việc lạm dụng hình ảnh

Quỹ Nhi đồng Liên hợp quốc (UNICEF) ngày càng quan ngại sâu sắc trước các báo cáo cho thấy số lượng hình ảnh có nội dung tình dục liên quan đến trẻ em được tạo ra bằng AI gia tăng nhanh chóng. Trong đó có cả những trường hợp hình ảnh của trẻ em bị chỉnh sửa và tình dục hóa.

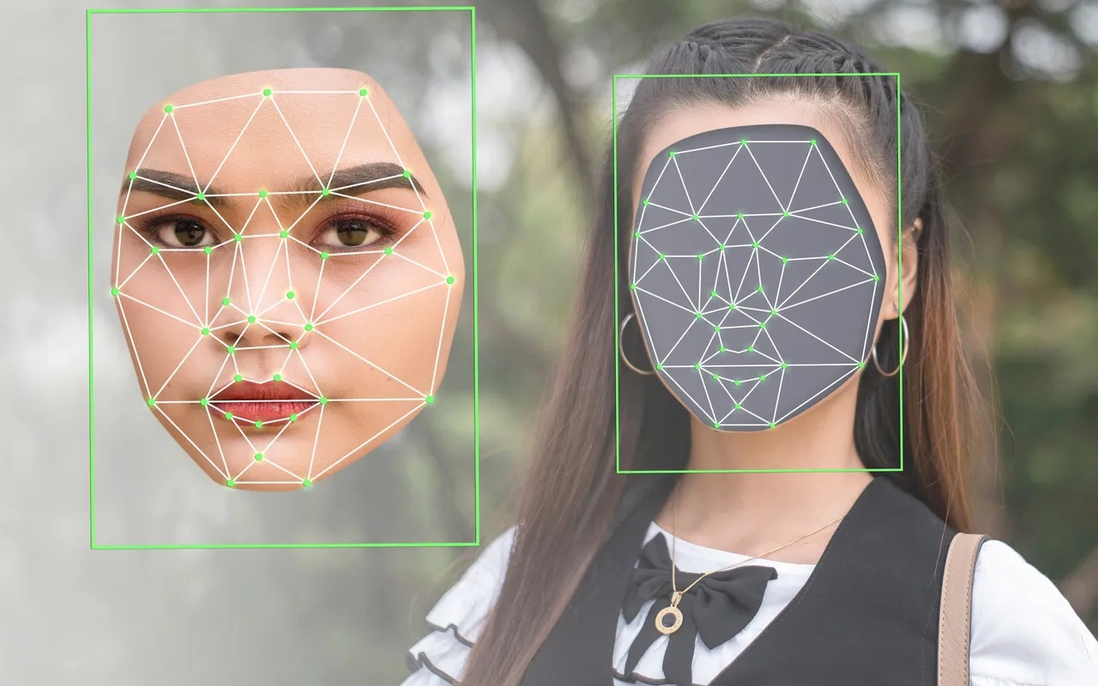

Công nghệ Deepfake - bao gồm hình ảnh, video hoặc âm thanh được tạo ra hoặc chỉnh sửa bằng AI để trông giống như thật, đang ngày càng bị lạm dụng nhằm sản xuất các nội dung tình dục liên quan đến trẻ em. Trong đó có hành vi "lột đồ bằng AI" khi các công cụ AI được sử dụng để loại bỏ hoặc thay đổi quần áo trong ảnh, tạo ra hình ảnh khỏa thân hoặc mang tính tình dục.

Công nghệ Deepfake ảnh hưởng đến trẻ em

Những bằng chứng mới cho thấy mức độ nghiêm trọng của mối đe dọa đang gia tăng nhanh chóng này. Một nghiên cứu do UNICEF, Mạng lưới quốc tế hàng đầu gồm các tổ chức xã hội dân sự chuyên trách việc chấm dứt mọi hình thức bóc lột tình dục trẻ em (ECPAT) và Tổ chức Cảnh sát Hình sự Quốc tế (INTERPOL) thực hiện tại 11 quốc gia cho thấy ít nhất 1,2 triệu trẻ em cho biết hình ảnh của các em đã bị biến đổi thành deepfake mang nội dung tình dục trong vòng một năm qua. Ở một số quốc gia, con số này đồng nghĩa vơi việc cứ 25 trẻ em - tương đương một lớp học - thì có một em từng trải qua tình huống này.

Với chủ đề "Cùng nhau vì một internet tốt đẹp hơn", Ngày An toàn Internet (10/2/2026) kêu gọi tất cả các bên liên quan cùng nhau chung tay để biến internet thành một nơi an toàn và tốt đẹp hơn cho tất cả mọi người, đặc biệt là trẻ em và thanh thiếu niên.

Đáng chú ý, bản thân trẻ em cũng nhận thức rất rõ về rủi ro này. Tại một số quốc gia tham gia nghiên cứu, có tới 2/3 trẻ em cho biết các em lo ngại AI có thể bị sử dụng để tạo ra hình ảnh hoặc video giả mạo mang nội dung tình dục. Mức độ lo ngại khác nhau giữa các quốc gia cho thấy sự cấp thiết của việc nâng cao nhận thức, phòng ngừa và bảo vệ trẻ em.

UNICEF khẳng định rõ ràng rằng mọi hình ảnh có nội dung tình dục liên quan đến trẻ em được tạo ra hoặc chỉnh sửa bằng AI là tài liệu xâm hại tình dục trẻ em (CSAM). Lạm dụng công nghệ deepfake là hành vi xâm hại thực sự, gây ra những tổn hại nghiêm trọng và lâu dài đối với trẻ em.

Cần bảo vệ trẻ em trước các hành vi xâm hại

Khi hình ảnh hoặc danh tính của trẻ em bị sử dụng, các em trở thành nạn nhân trực tiếp của hành vi xâm hại. Ngay cả trong những trường hợp không thể xác định rõ nạn nhân cụ thể, các tài liệu xâm hại tình dục trẻ em do AI tạo ra vẫn góp phần bình thường hóa hành vi xâm hại tình dục trẻ em, kích thích nhu cầu tiêu thụ các nội dung mang bản chất xâm hại, đồng thời đặt ra thách thức nghiêm trọng cho công tác thực thi pháp luật trong việc xác định và bảo vệ các em cần được hỗ trợ.

UNICEF hoan nghênh những nỗ lực của một số nhà phát triển AI trong việc áp dụng cách tiếp cận "an toàn ngay từ khâu thiết kế" và thiết lập các biện pháp bảo vệ mạnh mẽ nhằm ngăn chặn việc lạm dụng công nghệ.

Tuy nhiên, thực tế cho thấy các biện pháp này vẫn chưa đồng bộ, và nhiều mô hình AI vẫn thiếu các cơ chế bảo vệ đầy đủ. Rủi ro càng gia tăng khi các công cụ AI tạo sinh được tích hợp trực tiếp vào các nền tảng mạng xã hội, nơi hình ảnh bị chỉnh sửa có thể lan truyền rất nhanh.

Trước thực trạng đó, UNICEF khẩn thiết kêu gọi:

- Các chính phủ mở rộng định nghĩa về tài liệu xâm hại tình dục trẻ em (CSAM) để bao gồm cả nội dung do AI tạo ra, đồng thời hình sự hóa việc tạo ra, sở hữu, mua bán và phát tán các nội dung này.

- Các nhà phát triển AI áp dụng nghiêm túc nguyên tắc "an toàn ngay từ khâu thiết kế" và xây dựng các rào chắn kỹ thuật mạnh mẽ để ngăn chặn việc lạm dụng hệ thống AI.

- Các công ty công nghệ số chủ động ngăn chặn sự lan truyền của tài liệu xâm hại tình dục trẻ em do AI tạo ra, không chỉ gỡ bỏ sau khi hành vi xâm hại đã xảy ra. Cần tăng cường kiểm duyệt nội dung và đầu tư vào công nghệ phát hiện sớm để loại bỏ ngay lập tức, thay vì chờ nhiều ngày sau khi nạn nhân hoặc người đại diện báo cáo.

Những tổn hại do lạm dụng deepfake gây ra là có thật và đang diễn ra từng ngày. Trẻ em không thể chờ đợi cho đến khi luật pháp được sửa đổi.

Chính phủ Anh cho biết sẽ phối hợp với Microsoft, các trường đại học và các chuyên gia công nghệ để xây dựng hệ thống phát hiện nội dung deepfake trên môi trường mạng. Theo kế hoạch, Anh sẽ xây dựng một khung đánh giá chung nhằm kiểm tra hiệu quả của các công cụ phát hiện deepfake trong những tình huống thực tế như lừa đảo, giả mạo danh tính và xâm hại tình dục. Khung đánh giá này sẽ giúp chính phủ và các lực lượng thực thi pháp luật xác định những lỗ hổng còn tồn tại, đồng thời thiết lập các chuẩn mực rõ ràng cho doanh nghiệp công nghệ.

Nguồn: Theo UNICEF

Nhu Thụy

Nguồn Phụ Nữ VN : https://phunuvietnam.vn/12-trieu-tre-em-tren-the-gioi-da-bi-lam-dung-hinh-anh-thong-qua-ai-23826020915280776.htm

Tin khác

Ngừng GPT-4o: AI được thiết kế như 'bạn đồng hành' có thể tiềm ẩn nhiều rủi ro

5 giờ trước

Lưu lượng tăng cao dịp Tết, hành khách cần chuẩn bị gì khi đi máy bay?

2 giờ trước

Windows 11 ngừng hỗ trợ driver máy in V3 và V4: Người dùng cần lưu ý gì?

một giờ trước

Người dùng iPhone nên biết điều này để tránh mất quyền lợi

4 giờ trước

AI đang tái định hình truyền thông toàn cầu như thế nào

5 giờ trước

Mỹ mở rộng kiểm tra mạng xã hội trong quy trình cấp visa

6 giờ trước