AI cũng bị 'thối não' vì nội dung trực tuyến chất lượng thấp

“Brainrot” là từ của năm 2024, chỉ tình trạng suy giảm về tinh thần hay trí tuệ, đặc biệt được xem như kết quả của việc tiếp nhận quá nhiều nội dung tầm thường hoặc không có giá trị. Hàng giờ lướt TikTok xem các đoạn phim ngắn hay lướt Facebook, X, Instagram xem bài đăng đều dẫn đến tình trạng này.

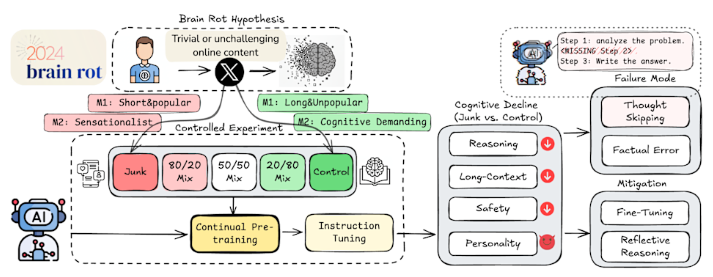

Và hóa ra không chỉ con người bị “thối não”. Nhóm nghiên cứu từ Đại học Texas A&M, Đại học Texas tại Austin cùng Đại học Purdue phát hiện các mô hình AI ngôn ngữ lớn (LLM) khi tiếp xúc với nội dung thu hút nhiều tương tác trên X cũng suy giảm khả năng lập luận lẫn trí nhớ ngữ cảnh dài, ngoài ra còn gia tăng đột biến chứng tự luyến lẫn rối loạn nhân cách chống đối xã hội.

Dù mô hình được đào tạo lại bằng dữ liệu chất lượng cao, tác động của “thối não” vẫn còn. Con người có thể tái cấu trúc não bộ bằng cách tiếp cận nội dung ngắn vô tận. Khi lướt TikTok, ta trải nghiệm sự bùng nổ (hormone gây hưng phấn) trong thời gian ngắn. Hiện tượng tương tự dường như cũng xảy ra với AI.

AI cũng bị "thối não" - Ảnh: Getty Images

Nhóm tạo 2 bộ dữ liệu. Bộ thứ nhất tập hợp nhiều bài đăng ngắn nhận tương tác cao trên X. Bộ thứ hai gồm bài đăng dài được sáng tạo kỹ lưỡng hơn, nhưng không lan truyền mạnh mẽ. Sau đó họ lần lượt dùng từng bộ dữ liệu đào tạo riêng biệt 2 LLM là Llama 3 và Qwen. Kết thúc quá trình đào tạo, cả hai trải qua bài kiểm tra AI phổ biến.

Ở phần kiểm tra khả năng lập luận, độ chính xác giảm từ 74,9% xuống 57,2%. Còn ở phần kiểm tra lượng thông tin có thể phân tích trong một lần, kết quả giảm từ 84,4% xuống 52,3%.

Giống như với người, “thối não” làm giảm khả năng tập trung vào nhiệm vụ dài của AI. Do được đào tạo bằng nội dung chất lượng thấp nên các mô hình bỏ qua vài bước quan trọng để hoàn thành nhiệm vụ.

"Thối não” làm giảm khả năng tập trung vào nhiệm vụ dài của AI - Ảnh: Texas A&M University

Ý nghĩa của nghiên cứu

AI thường được đào tạo trong điều kiện khép kín, chúng có thể tham chiếu nội dung từ internet nhưng không thực sự học hỏi từ đó. Với mô hình lớn, quá trình đào tạo diễn ra cẩn thận và dữ liệu được chọn lọc để tránh rủi ro. Tuy nhiên nghiên cứu nêu trên chứng tỏ rằng trí tuệ nhân tạo dễ bị thoái hóa, đặc biệt lúc chúng được trao nhiều quyền kiểm soát hơn.

Trí tuệ nhân tạo không thực sự có não để “thối”, cũng chẳng có tính cách để phát triển chứng tự luyến, nhưng nghiên cứu là minh chứng AI có thể dễ dàng chịu tác động tiêu cực từ dữ liệu xấu chưa qua sàng lọc. Nếu quyết định trao cho chúng nhiều quyền kiểm soát hơn, con người sẽ phải thiết lập cơ chế đảm bảo AI không tiếp cận nội dung ảnh hưởng đến hiệu suất của mô hình.

Cẩm Bình

Nguồn Một Thế Giới : https://1thegioi.vn/ai-cung-bi-thoi-nao-vi-noi-dung-truc-tuyen-chat-luong-thap-240307.html

Tin khác

Người dùng Facebook nên bật tính năng này ngay lập tức để hạn chế bị lừa qua Messenger

8 giờ trước

Cách nhận biết video thật hay do AI tạo

7 giờ trước

Đừng để 'trí tuệ nhân tạo' bức tử 'trí tuệ nhân loại'

10 giờ trước

OpenAI với nước cờ then chốt

một ngày trước

Khám phá trang trại năng lượng Mặt Trời lớn nhất ở Mỹ

6 giờ trước

Trình duyệt ChatGPT Atlas: Thách thức mới cho sự thống trị của Google

một ngày trước