'Át chủ bài' mới của Nvidia đã lộ diện

Tại hội nghị GTC thường niên, Nvidia đã công bố những bước tiến mới nhất trong cuộc đua thống trị thị trường chip trí tuệ nhân tạo (AI) với hai dòng sản phẩm chủ lực mới là Blackwell Ultra và Vera Rubin.

Theo CEO Jensen Huang, Blackwell Ultra dự kiến ra mắt vào nửa cuối năm 2025. Trong khi đó, Vera Rubin - kiến trúc GPU thế hệ tiếp theo sẽ xuất hiện vào năm 2026, tiếp theo là Rubin Ultra vào năm 2027.

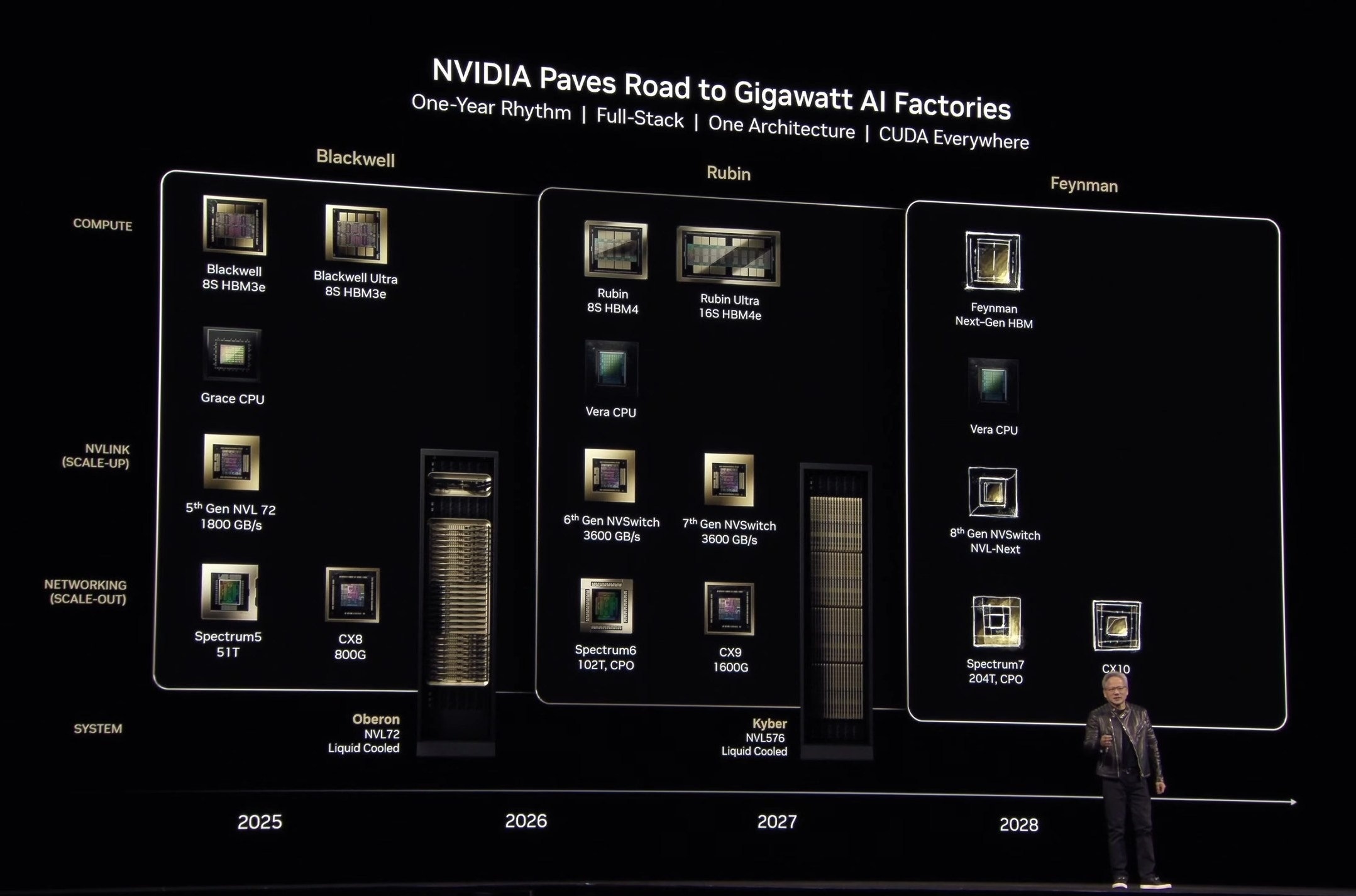

Những công bố này không chỉ thể hiện sức mạnh công nghệ vượt trội của Nvidia mà còn đánh dấu sự thay đổi trong chiến lược phát hành sản phẩm của hãng khi chuyển từ chu kỳ hai năm một lần sang hàng năm.

Blackwell Ultra: Bước tiến vượt bậc trên nền tảng Blackwell

Năm 2024, con chip AI Blackwell đã tâm điểm. Theo tiết lộ từ ông lớn sản xuất chip, các bộ xử lý dựa trên kiến trúc Blackwell, như GB200 mang lại sự nâng cấp hiệu suất rất lớn cho các doanh nghiệp ứng dụng AI.

Mặc dù vậy, phải đến gần đây, Blackwell mới bắt đầu được xuất xưởng với số lượng lớn sau những chậm trễ liên quan đến việc sản xuất hàng loạt thiết kế phức tạp.

Trong ngành dậy sóng những tin đồn về sai sót thiết kế của nền tảng nói trên. Thời gian mở giao hàng ban đầu là Quý III/2024 đã được chuyển sang năm 2025. Trong cuộc họp sau khi công bố báo cáo tài chính, một nửa nhà đầu tư của NVIDIA đã đặt câu hỏi về vấn đề của Blackwell.

Để "bù đắp", Jensen Huang đã giới thiệu một phiên bản nâng cấp của dòng chip này, mang tên Blackwell Ultra trong bài phát biểu tại sự kiện.

Lộ trình ra mắt các thế GPU mới của Nvidia. Ảnh: Nvidia.

Cụ thể, Blackwell Ultra là phiên bản nâng cấp của kiến trúc Blackwell, tập trung vào việc tối ưu hóa hiệu suất và bộ nhớ cho các tác vụ AI ngày càng phức tạp.

Mặc dù không phải là một kiến trúc hoàn toàn mới, Blackwell Ultra vẫn mang đến những cải tiến đáng kể so với thế hệ trước, đặc biệt là H100 (ra mắt năm 2022), dòng chip đã đặt nền móng cho sự thành công của Nvidia trong lĩnh vực AI.

Theo đó, một chip Blackwell Ultra đơn lẻ sở hữu hiệu năng AI đạt 20 petaflops, tương đương với Blackwell, nhưng được trang bị bộ nhớ HBM3e lên đến 288 GB. Nâng cấp này tăng đáng kể so với bộ nhớ 192 GB của Blackwell. Điều này đặc biệt quan trọng đối với các mô hình AI lớn đòi hỏi khả năng truy cập dữ liệu nhanh chóng.

So với H100, Blackwell Ultra mang lại hiệu năng suy luận FP4 gấp 1.5 lần và tăng tốc đáng kể khả năng "lý luận AI".

Cụm NVL72 sử dụng Blackwell Ultra có thể chạy mô hình ngôn ngữ lớn DeepSeek-R1 671B và đưa ra câu trả lời chỉ trong 10 giây, một bước nhảy vọt so với 1,5 phút của H100. Đặc biệt, chip mới này có khả năng xử lý tới 1.000 token mỗi giây, con số gấp 10 lần so với H100.

Theo Nvidia, các khách hàng lớn đã mua số lượng chip Blackwell gấp 3 lần so với Hopper, cho thấy sự tin tưởng và nhu cầu mạnh mẽ đối với kiến trúc này.

Kiến trúc GPU thế hệ tiếp theo cho năm 2026

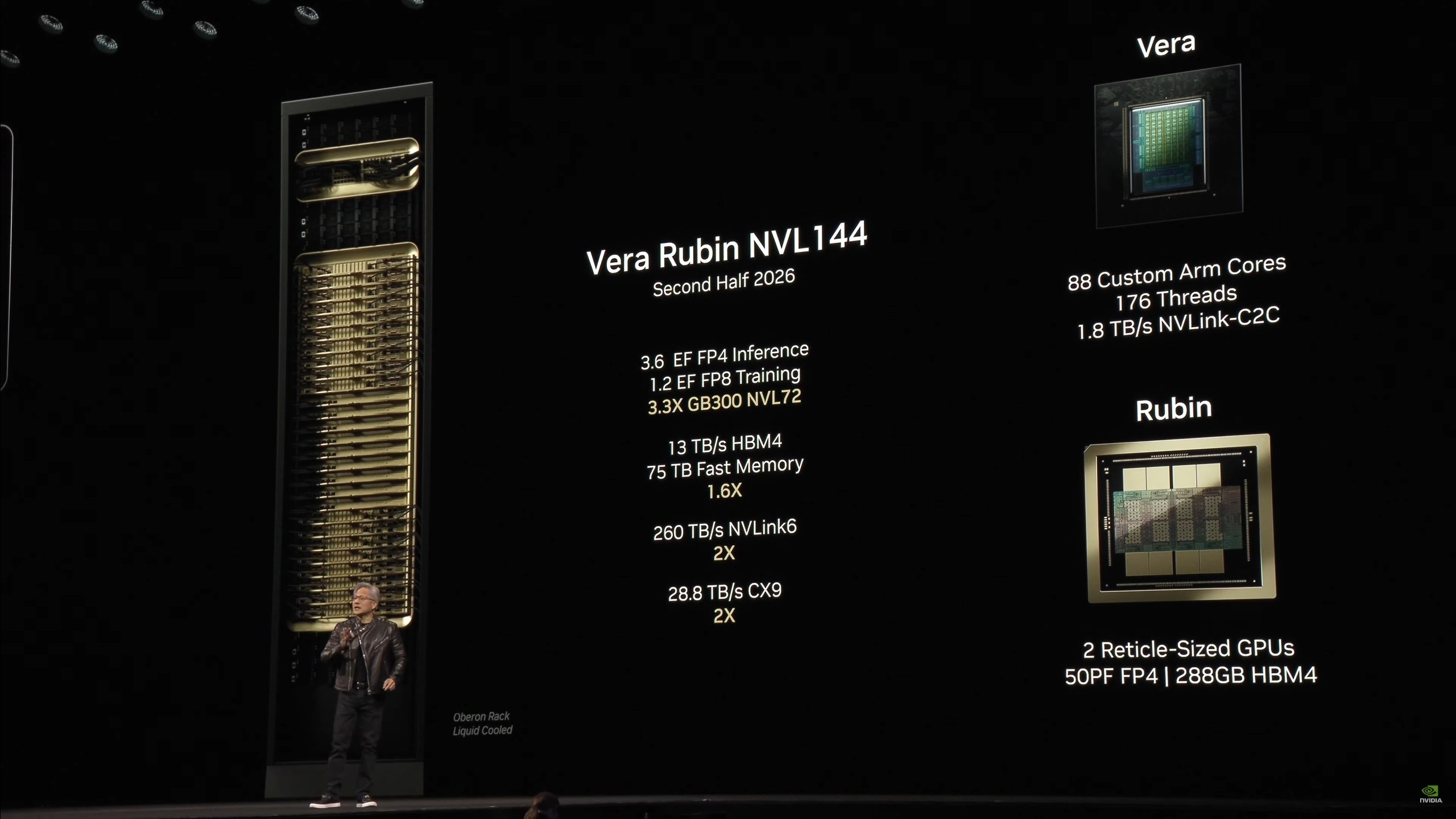

Nối tiếp Blackwell Ultra, gã khổng lồ chip hé lộ về kiến trúc GPU thế hệ tiếp theo mang tên Vera Rubin, dự kiến ra mắt vào nửa cuối năm 2026. Hệ thống này bao gồm hai thành phần chính là CPU Vera (thiết kế CPU tùy chỉnh đầu tiên của Nvidia dựa trên kiến trúc Olympus) và GPU Rubin.

Theo The Verge, CPU Vera được thiết kế với tốc độ nhanh gấp đôi CPU được sử dụng trong chip Grace Blackwell năm 2024.

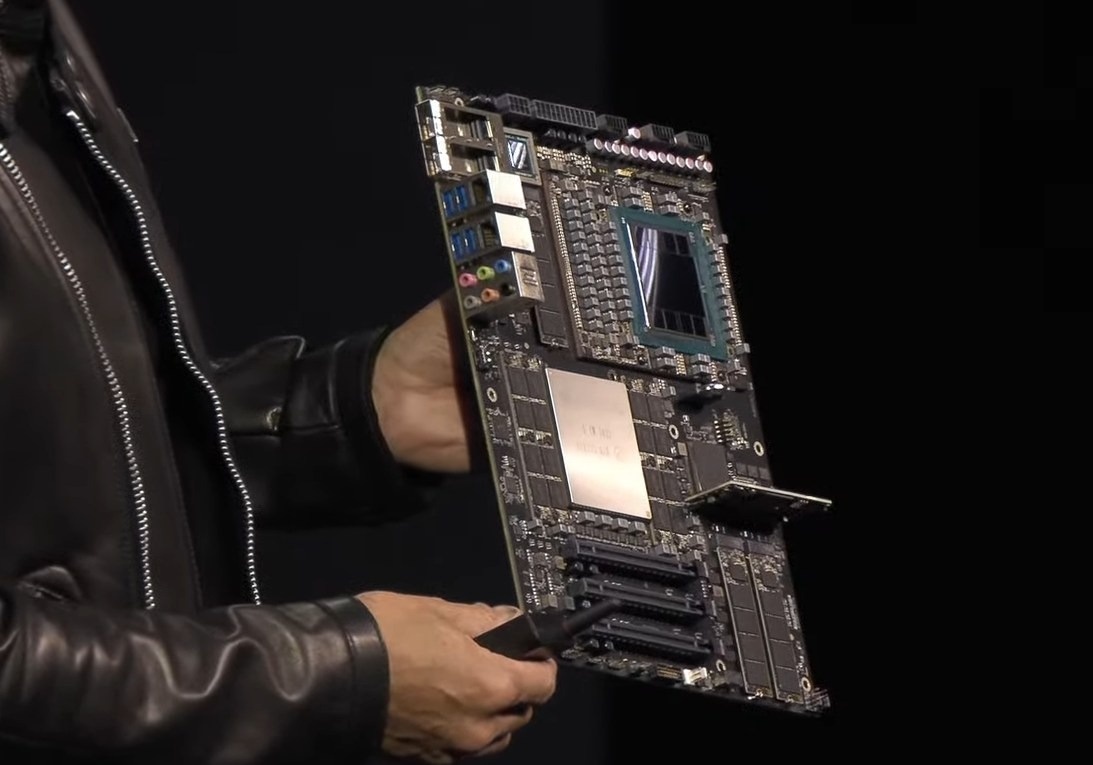

Bo mạch chủ máy tính để bàn DGX Station tích hợp GPU Blackwell Ultra của Nvidia trên bo mạch. Ảnh: Nvidia.

Trong khi đó, GPU Rubin hứa hẹn mang lại hiệu suất vượt trội với khả năng quản lý 50 petaflops khi thực hiện suy luận, hơn gấp đôi so với 20 petaflops của chip Blackwell hiện tại. Rubin cũng hỗ trợ bộ nhớ nhanh lên đến 288 GB, một thông số quan trọng đối với các nhà phát triển AI.

Ngoài ra, một thay đổi đáng chú ý là Nvidia sẽ định nghĩa lại khái niệm GPU với Rubin. Thay vì xem xét một chip duy nhất được lắp ráp từ nhiều thành phần là một GPU, Nvidia sẽ gọi mỗi thành phần là một GPU riêng biệt khi chúng được kết hợp lại. Điều này đồng nghĩa chip Rubin sẽ có tới hai GPU trên một con chip.

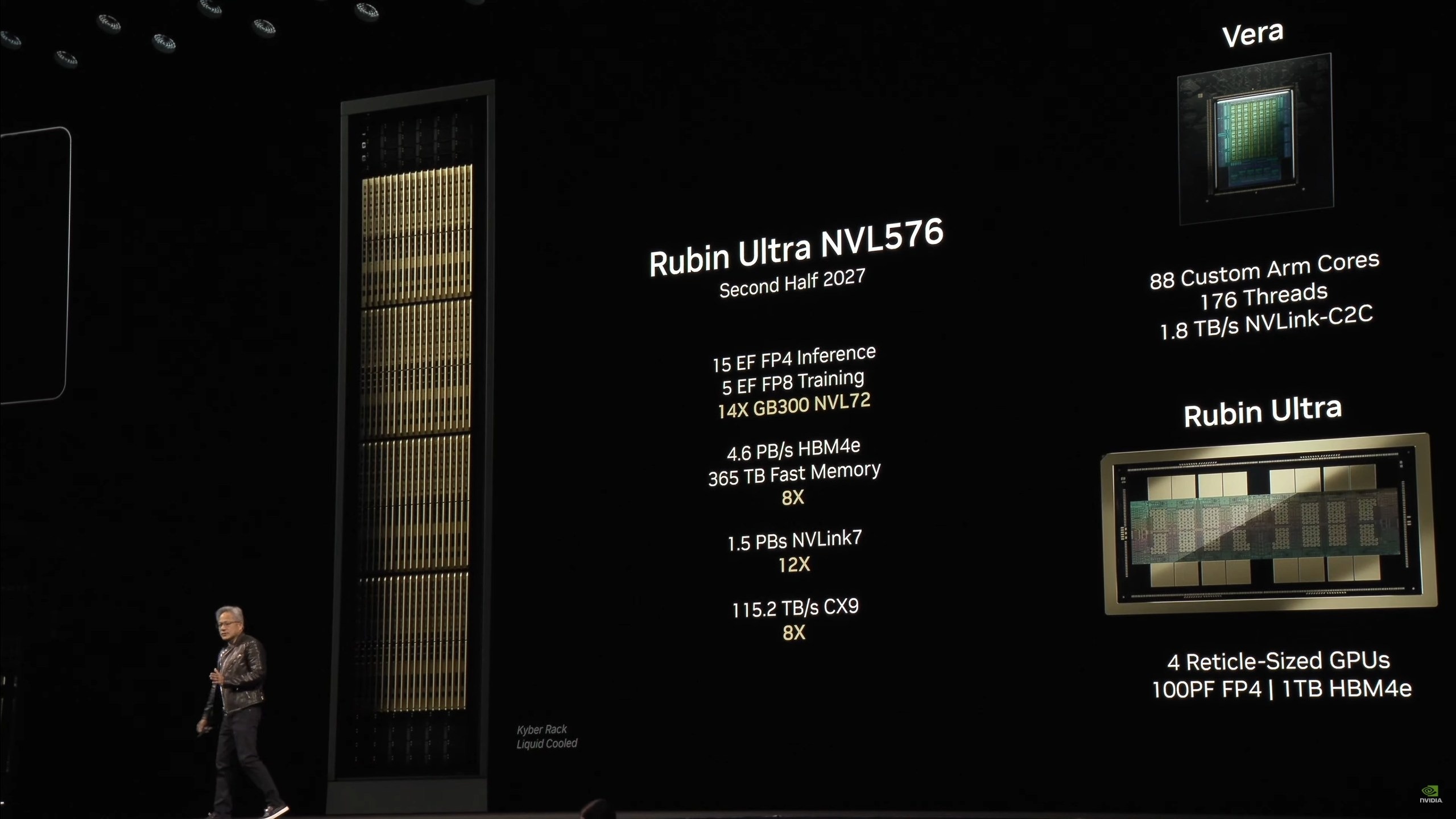

Cuối cùng, nhà sản xuất GPU lớn nhất thế giới dự kiến ra mắt Rubin Ultra (còn được gọi là Rubin Next) vào nửa cuối năm 2027. Rubin Ultra sẽ là một bước tiến lớn về hiệu năng, khi một chip duy nhất sẽ chứa hai GPU Rubin kết nối với nhau, mang lại hiệu suất FP4 lên đến 100 petaflops.

Để so sánh, hiệu năng này gấp đôi so với GPU Rubin. Ngoài ra, bộ nhớ của Rubin Ultra cũng được nâng cấp đáng kể đạt 1 TB.

Ở phần cuối bài thuyết trình, Nvidia tiếp tục hé lộ về lộ trình phát triển dài hạn khi cho biết kiến trúc chip sau Vera Rubin, dự kiến ra mắt vào năm 2028, sẽ được đặt tên là Feynman dựa theo tên nhà vật lý lý thuyết nổi tiếng Richard Feynman.

Hiệu năng của bộ đôi sử dụng kiến trúc GPU thế hệ tiếp theo mang tên Vera Rubin dự kiến ra mắt vào năm 2026 và 2027. Ảnh: Nvidia.

Những công bố mới này diễn ra trong bối cảnh Nvidia đang hưởng lợi lớn từ sự bùng nổ của AI. Doanh số của công ty đã tăng 6 sáu lần kể từ khi ChatGPT ra mắt, nhờ vào sự thống trị của GPU Nvidia trong lĩnh vực phát triển AI.

Nhu cầu về sức mạnh tính toán AI đang tăng trưởng với tốc độ chóng mặt và CEO Jensen Huang tin rằng ngành công nghiệp cần sức mạnh tính toán gấp 100 lần so với dự đoán của năm 2024 để đáp ứng nhu cầu này.

Một điểm nhấn đáng chú ý tại GTC 2025 là việc Nvidia đang hợp tác chặt chẽ với các công ty AI hàng đầu, bao gồm cả DeepSeek của Trung Quốc. Việc sử dụng mô hình R1 của DeepSeek để đo điểm chuẩn cho các chip mới cho thấy ông lớn bán dẫn này chú trọng đến hiệu suất trong các tác vụ suy luận phức tạp.

Anh Tuấn

Nguồn Znews : https://znews.vn/at-chu-bai-moi-cua-nvidia-da-lo-dien-post1539279.html

Tin khác

Nvidia công bố hai 'siêu máy tính AI cá nhân'

17 giờ trước

Vì sao gã khổng lồ sản xuất chip Intel ngày càng 'hụt hơi' so với các đối thủ?

13 giờ trước

Tờ báo AI đầu tiên trên thế giới

13 giờ trước

Dùng AI hỗ trợ tuyển 8.000 nhân viên/năm

14 giờ trước

Trung Quốc 'bình dân hóa' công nghệ xe tự hành nhờ AI

14 giờ trước

Google Gemini nguy cơ đối mặt với vấn đề vi phạm bản quyền

19 giờ trước