ChatGPT trở thành cố vấn sức khỏe nhưng quyền riêng tư và lòng tin vẫn là bài toán khó

OpenAI đang mở rộng vai trò của AI trong chăm sóc sức khỏe khi hàng chục triệu người sử dụng ChatGPT hàng ngày để tìm hiểu triệu chứng, lựa chọn điều trị và hướng dẫn y tế.

Sự ra đời của ChatGPT Health với khả năng kết nối hồ sơ y tế và cá nhân hóa thông tin hứa hẹn mang đến trải nghiệm mới. Đồng thời cũng đặt ra những thách thức về quyền riêng tư, bảo mật và lòng tin.

Các chuyên gia cảnh báo rằng, dù AI có thể hỗ trợ tra cứu và hướng dẫn, việc chia sẻ dữ liệu y tế nhạy cảm cần được cân nhắc cẩn trọng, đặc biệt trong bối cảnh công nghệ vẫn chưa thay thế được sự giám sát và tư vấn trực tiếp từ bác sĩ.

AI LÀM CỐ VẤN SỨC KHỎE

Mới đây, OpenAI đã công bố báo cáo cho thấy hiện có khoảng 40 triệu người sử dụng ChatGPT mỗi ngày để đặt câu hỏi liên quan đến sức khỏe, một con số tưởng khủng vài năm trước nhưng nay đã gần như trở thành hiện thực.

Công ty mô tả chatbot của mình như một “đồng minh chăm sóc sức khỏe”, cho phép người dùng tra cứu triệu chứng, thông tin về thuốc, các lựa chọn điều trị và hướng dẫn trong hệ thống y tế thường quá tải.

Theo báo cáo, hơn 5% tổng số lệnh truy vấn ChatGPT liên quan đến sức khỏe, trong khi trên 800 triệu người sử dụng hàng tuần của chatbot có tới 200 triệu người đặt ít nhất một câu hỏi về sức khỏe mỗi tuần.

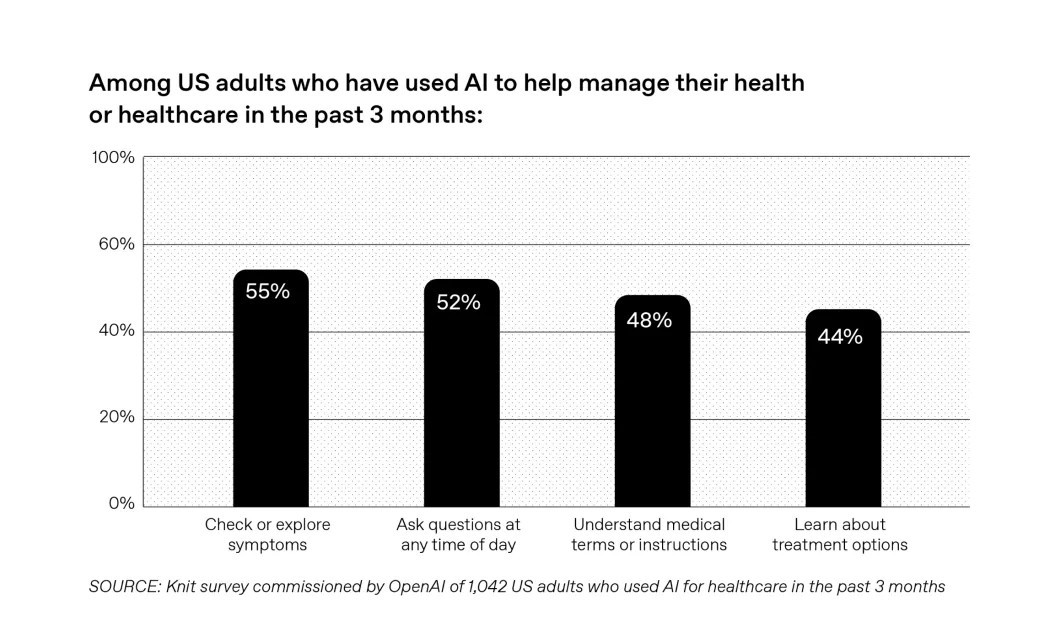

Một khảo sát trên 1.042 người trưởng thành tại Mỹ, những người đã dùng AI cho mục đích chăm sóc sức khỏe trong ba tháng gần đây, cho thấy 55% sử dụng AI để kiểm tra hoặc tìm hiểu triệu chứng, 52% hỏi các câu hỏi về chăm sóc sức khỏe bất cứ lúc nào trong ngày, 48% muốn hiểu các thuật ngữ hoặc hướng dẫn y tế, 44% tìm hiểu về các phương án điều trị.

Khảo sát tại Mỹ (Nguồn: OpenAI)

OpenAI nhận định những con số này phản ánh cách người Mỹ sử dụng AI để tổ chức thông tin, dịch các thuật ngữ chuyên môn và tạo các bản nháp mà họ có thể kiểm chứng.

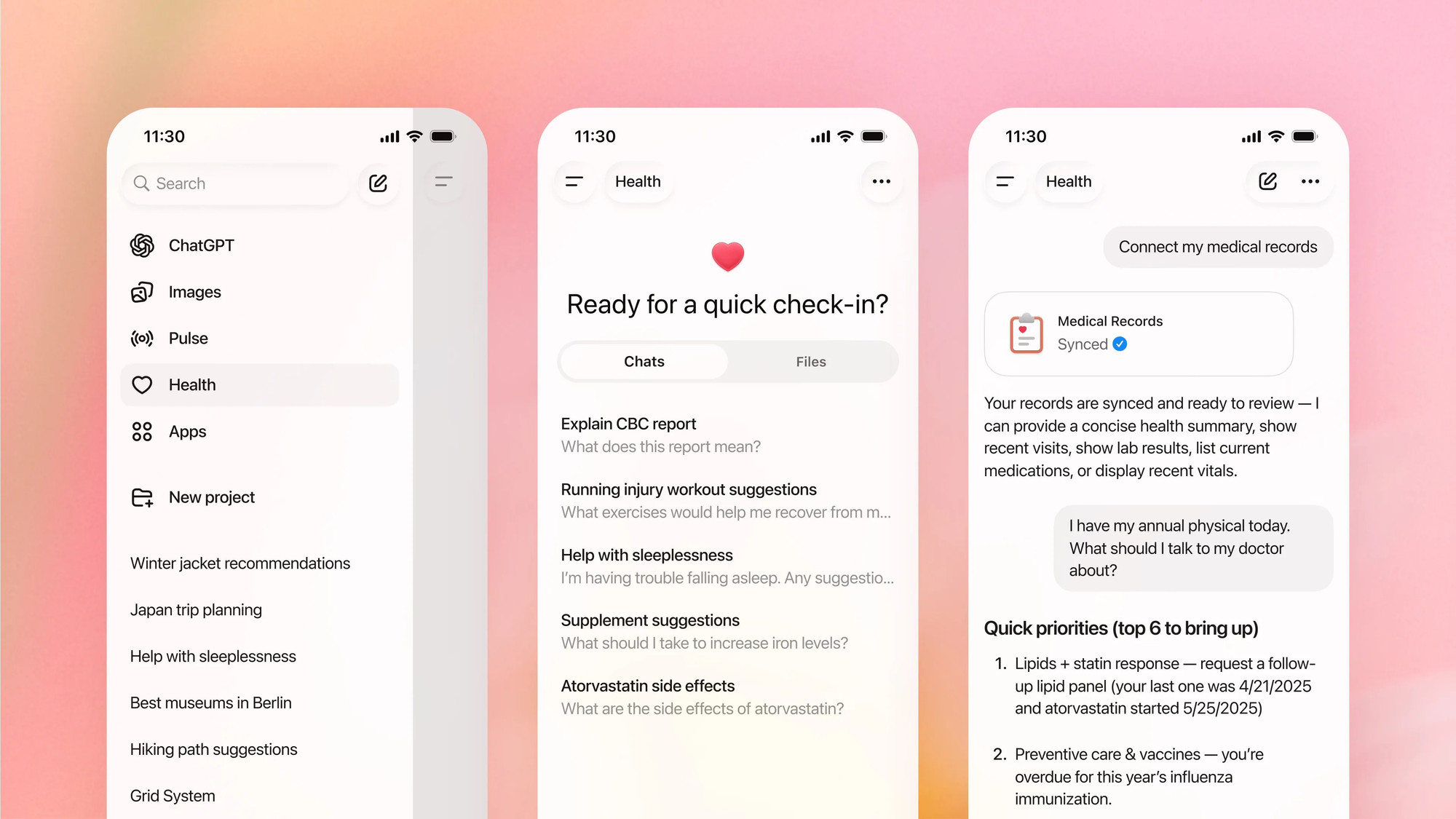

Ngay sau khi công bố 40 triệu người dùng ChatGPT hỏi về sức khỏe mỗi ngày, OpenAI đã cho ra mắt ChatGPT Health, một công cụ chuyên biệt với không gian riêng trong ứng dụng, thiết kế để hỗ trợ các cuộc trò chuyện y tế.

Tính năng này cho phép kết nối an toàn với hồ sơ y tế cá nhân và các ứng dụng chăm sóc sức khỏe, thể dục như Apple Health, Function hay MyFitnessPal, mang lại trải nghiệm cá nhân hóa hơn khi đặt câu hỏi, giải mã thông điệp từ bác sĩ hoặc hiểu kết quả xét nghiệm. Người dùng hoàn toàn kiểm soát mức độ truy cập của các ứng dụng này, có thể ngắt kết nối bất kỳ lúc nào và dữ liệu sẽ không còn được truy cập.

OpenAI đã hợp tác với hơn 260 bác sĩ ở 60 quốc gia để tinh chỉnh cách ChatGPT Health phản hồi, xác định khi nào nên gợi ý gặp bác sĩ và đảm bảo giao tiếp rõ ràng mà không làm quá đơn giản hóa thông tin.

Công cụ này có thể trả lời các câu hỏi chung như cách chuẩn bị cho cuộc khám sức khỏe định kỳ, gợi ý chương trình tập luyện dựa trên dữ liệu Apple Health, so sánh các gói bảo hiểm để lựa chọn phù hợp nhất.

ChatGPT Health có thể trả lời các câu hỏi chung

Hiện ChatGPT Health chưa phổ biến rộng rãi và chỉ có thể truy cập thông qua danh sách chờ. Người dùng các gói Free, Go, Plus và Pro (ngoại trừ Khu vực Kinh tế Châu Âu, Thụy Sĩ và Vương quốc Anh) đủ điều kiện tham gia nhưng OpenAI dự kiến sẽ mở rộng truy cập trên web và iOS trong vài tuần tới.

Công ty nhấn mạnh ChatGPT Health nhằm hỗ trợ chứ không thay thế bác sĩ, việc ra mắt dịch vụ này phản ánh vai trò ngày càng trung tâm của AI trong chăm sóc sức khỏe.

Dịch vụ cho phép người dùng tải lên toàn bộ hồ sơ y tế và kết quả xét nghiệm để tham gia chủ động hơn vào việc quản lý sức khỏe và thể chất, đồng thời cung cấp gợi ý về các lựa chọn bảo hiểm.

BỦA VÂY NHỮNG LO NGẠI

Thế nhưng, việc cung cấp quyền truy cập hồ sơ sức khỏe cho OpenAI đã đặt ra những mối quan ngại đáng kể về quyền riêng tư và bảo mật. Thông tin y tế được coi là một trong những loại dữ liệu nhạy cảm nhất và việc giao dữ liệu này cho một công ty hoạt động vì lợi nhuận khiến nhiều người băn khoăn về mức độ an toàn.

OpenAI đã thừa nhận rằng nhận thức về việc người dùng chia sẻ thông tin cá nhân và nhạy cảm đã định hình cách công ty thiết kế các biện pháp bảo mật, quyền riêng tư và kiểm soát dữ liệu cho tất cả sản phẩm ngay từ giai đoạn đầu.

Ngay cả trước khi ra mắt ChatGPT Health, công ty đã triển khai các biện pháp cơ bản như trò chuyện tạm thời, khả năng xóa cuộc trò chuyện trong vòng 30 ngày và đảm bảo rằng việc huấn luyện mô hình không lưu giữ thông tin cá nhân từ các cuộc trò chuyện của người dùng.

Công ty cũng giải thích rằng tất cả cuộc trò chuyện và tệp trên ChatGPT đều được mã hóa mặc định khi lưu trữ và truyền tải. Với ChatGPT Health, các biện pháp bảo vệ bổ sung nhiều lớp bao gồm mã hóa và tách riêng dữ liệu chuyên dụng được áp dụng để giữ các cuộc trò chuyện về sức khỏe an toàn và riêng biệt.

Các cuộc trò chuyện trong Health không được sử dụng để huấn luyện mô hình nền tảng, nhờ đó dữ liệu sức khỏe được giữ hoàn toàn riêng biệt so với các cuộc trò chuyện thông thường.

Tuy nhiên, theo Techradar, vấn đề cốt lõi vẫn là lòng tin. Mặc dù nhiều người đánh giá cao ChatGPT và các tính năng của nó, vẫn tồn tại sự hoài nghi về việc dựa vào một công cụ có khả năng tưởng tượng thông tin tự do cho những vấn đề sức khỏe quan trọng. Việc cung cấp dữ liệu y tế thực sự cho AI đặt ra nguy cơ riêng, nhất là khi công ty là thực thể thương mại với lịch sử bảo mật chưa hoàn hảo.

Alexander Tsiaras, nhà sáng lập kiêm CEO của nền tảng dữ liệu y tế StoryMD, nhấn mạnh rằng khám phá một câu hỏi sức khỏe đơn lẻ hoàn toàn khác với việc trao quyền truy cập toàn bộ hồ sơ y tế và lịch sử sức khỏe suốt đời cho một nền tảng.

"Lòng tin sẽ là thách thức cốt lõi, không chỉ đối với cá nhân mà còn với toàn bộ hệ thống y tế. Lòng tin này phụ thuộc vào sự minh bạch gồm cách dữ liệu được nhập, cách ngăn chặn thông tin tưởng tượng, cách tích hợp bằng chứng lâm sàng theo thời gian và việc nền tảng có hoạt động trong khung pháp lý hiện hành hay không", Alexander Tsiaras, nhà sáng lập kiêm CEO của nền tảng dữ liệu y tế StoryMD khẳng định.

Một vấn đề khác là OpenAI không phải là nhà cung cấp dịch vụ y tế và HIPAA (luật liên bang của Mỹ năm 1996) cùng các nghĩa vụ pháp lý bảo vệ thông tin y tế nghiêm ngặt không áp dụng cho công ty.

Do đó, dù công ty cam kết xử lý dữ liệu sức khỏe với mức độ bảo mật cao, người dùng vẫn phải dựa vào chính sách và ý định của công ty, thay vì các tiêu chuẩn pháp lý bắt buộc.

Kiểm soát dữ liệu sức khỏe là một thách thức. Mặc dù việc tách riêng các cuộc trò chuyện sức khỏe và cho phép xóa dữ liệu là các biện pháp tích cực, dữ liệu ra khỏi hệ thống chăm sóc y tế truyền thống vẫn chịu nhiều rủi ro khác.

Các nền tảng công nghệ lớn khó đảm bảo bảo vệ dữ liệu tuyệt đối trước rò rỉ, hack hay yêu cầu pháp lý bởi dữ liệu sức khỏe cá nhân có thể bị trát đòi hầu tòa hoặc yêu cầu cung cấp trong quá trình điều tra. HIPAA cung cấp các biện pháp bảo vệ mạnh hơn so với các luật bảo mật tiêu chuẩn dành cho người tiêu dùng mà ChatGPT áp dụng.

Chăm sóc sức khỏe dễ tiếp cận và giá cả phải chăng là mục tiêu đáng hướng tới nhưng quyền riêng tư, lòng tin và giám sát con người không thể bị hy sinh. Các chuyên gia nhấn mạnh rằng việc tích hợp AI vào hệ thống y tế cần được cân nhắc cẩn trọng.

AI có thể là công cụ hỗ trợ đắc lực nhưng không thể dựa trên việc từ bỏ dữ liệu cá nhân vào môi trường bảo mật không chắc chắn. Điều người dùng thực sự cần là hồ sơ y tế dài hạn, đáng tin cậy, hỗ trợ tương tác thực sự giữa bệnh nhân và nhà cung cấp, thay vì thêm một lớp thông tin nhiễu từ AI.

Bên cạnh đó, các cố vấn được trang Health & Protection trao đổi cho rằng người dùng đã thử nghiệm AI cho nhu cầu sức khỏe và lo ngại về cách sử dụng và kết quả. John Kerr từ công ty Incorporate Benefits lưu ý nhiều người dùng dựa vào ChatGPT để lập chương trình tập luyện hoặc kế hoạch ăn uống. Nếu cung cấp quá nhiều thông tin cá nhân, dữ liệu có thể gặp rủi ro vì không rõ cuối cùng đi đâu.

Brett Hill, công ty Broadstone, nhấn mạnh AI sẽ ảnh hưởng lớn đến chăm sóc y tế, đặc biệt trong chẩn đoán ung thư. Dù vậy, vẫn cần thận trọng khi chia sẻ dữ liệu cá nhân với công cụ AI mở bởi AI tạo sinh dễ mắc lỗi và có thể gây lo lắng không cần thiết nếu thông tin sai lệch.

Ngoài ra, nguy cơ từ việc tự chẩn đoán trực tuyến cũng được cảnh báo. Kristian Breeze từ Ascend Health cho biết mọi người thường tự chẩn đoán và AI có thể khiến họ đưa ra những giả định vô căn cứ. Các dịch vụ này đặc biệt rủi ro với người có mức độ lo lắng về sức khỏe cao và cần thiết lập các giới hạn rõ ràng để sử dụng thực tế.

Trong khi đó, Alan Lakey từ Highclere Financial Services nhận định rằng các công cụ AI có thể giúp người tiêu dùng hiểu về sức khỏe và giảm béo phì nhưng cần đánh giá kỹ các rủi ro tiềm ẩn.

Minh Hiếu

Nguồn Thương Gia : https://thuonggiaonline.vn/chatgpt-tro-thanh-co-van-suc-khoe-nhung-quyen-rieng-tu-va-long-tin-van-la-bai-toan-kho-post567349.html

Tin khác

Malaysia tuyên bố khởi kiện X vì AI của Elon Musk

4 giờ trước

Bê bối Grok và lỗ hổng kiểm soát AI tạo sinh

4 giờ trước

Tại sao VNeID và app ngân hàng yêu cầu đổi mật khẩu định kỳ 6 tháng một lần?

4 giờ trước

Pháp cân nhắc cấm trẻ em dưới 15 tuổi sử dụng mạng xã hội

một giờ trước

Apple bắt tay Gemini để vận hành Siri tích hợp AI

8 giờ trước

Mất 'nóng' 50 triệu đồng, người đàn ông thiếu cảnh giác tiếp tục 'bay hơi' 800 triệu

một giờ trước