Google, Amazon, Microsoft và Meta tự làm chip AI: Đế chế Nvidia lung lay?

Năm 2026 được xem là bước ngoặt của ngành công nghệ khi tổng chi tiêu hạ tầng của bốn tập đoàn lớn - Google, Amazon, Microsoft và Meta - được dự báo tiến gần mốc 700 tỉ USD. Phần lớn nguồn vốn này tập trung vào phần cứng trí tuệ nhân tạo, phản ánh mức độ cạnh tranh ngày càng gay gắt trong lĩnh vực tính toán hiệu năng cao. Ở trung tâm xu thế đó, Nvidia nổi lên như một trụ cột then chốt, với giá trị vốn hóa vượt 5.000 tỉ USD nhờ cung cấp các dòng GPU hàng đầu thị trường. Tuy nhiên, đà tăng trưởng ấn tượng này cũng kéo theo những lo ngại từ chính các khách hàng lớn.

Kỷ nguyên độc quyền Nvidia của lung lay khi Google, Meta và Microsoft tự sản xuất chip AI. Ảnh: HV

Các dòng GPU dành cho trung tâm dữ liệu của Nvidia duy trì biên lợi nhuận cao, đồng nghĩa với chi phí đầu vào lớn đối với các nhà cung cấp dịch vụ đám mây. Việc phụ thuộc vào một nguồn cung duy nhất không chỉ ảnh hưởng đến hiệu quả tài chính mà còn tiềm ẩn rủi ro gián đoạn chuỗi cung ứng. Trước áp lực tối ưu chi phí và nâng cao hiệu suất đầu tư, các tập đoàn công nghệ buộc phải tìm cách giảm sự lệ thuộc này. Xu hướng phát triển phần cứng nội bộ vì vậy đang được đẩy mạnh, đánh dấu sự chuyển dịch âm thầm nhưng rõ rệt khỏi mô hình phụ thuộc vào một hệ sinh thái duy nhất.

Google TPU: Từ vũ khí bí mật đến nền tảng thương mại hóa

Trong cuộc đua tự chủ silicon, Google là cái tên đi trước thời đại khi bắt tay vào phát triển Bộ xử lý Tensor (TPU) từ tận năm 2015. Bước sang năm 2026, thế hệ TPU mới nhất của hãng, đặc biệt là kiến trúc Ironwood (TPU v7), đã không còn là một dự án nghiên cứu nội bộ mà vươn lên thành một đối trọng thực sự của GPU Nvidia trên thị trường. Không giống như thiết kế đa dụng của GPU, TPU của Google là một cỗ máy được tối ưu hóa chuyên biệt cho các phép toán đại số tuyến tính quy mô lớn, vốn là cốt lõi của các siêu mô hình ngôn ngữ dựa trên kiến trúc Transformer như Gemini.

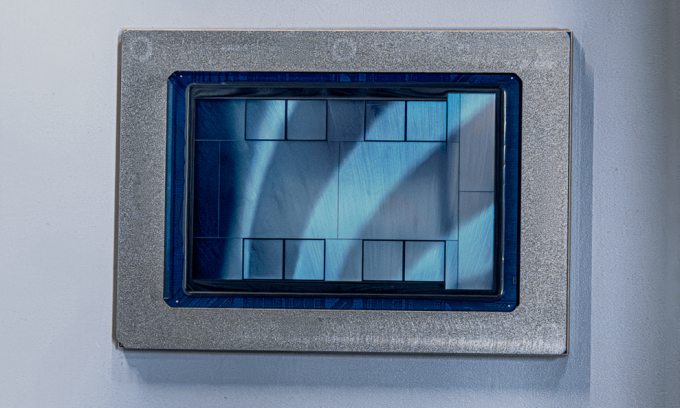

Các dòng chip AI TPU đang giúp Google từng bước giảm phụ thuộc vào hệ sinh thái GPU của Nvidia. Ảnh: Google

Điểm bứt phá đáng chú ý nhất của Alphabet trong thời gian gần đây là quyết định thay đổi mô hình kinh doanh phần cứng. Họ không chỉ giữ TPU cho riêng các trung tâm dữ liệu của mình mà bắt đầu cung cấp nền tảng này cho các khách hàng doanh nghiệp lớn. Điển hình là Anthropic, một trong những phòng thí nghiệm AI hàng đầu thế giới, đã cam kết sử dụng hạ tầng hàng triệu vi mạch TPU của Google để huấn luyện và vận hành các phiên bản mô hình Claude. Nhờ khả năng tự chủ toàn diện từ thiết kế vi mạch chuyên biệt, xây dựng mô hình nền tảng cho đến vận hành trung tâm dữ liệu, biên lợi nhuận mảng đám mây của Google đã tăng vọt lên mức kỷ lục 33% trong quý đầu năm 2026. Đây là minh chứng rõ nét nhất cho lợi ích tài chính khổng lồ của chiến lược "tự cung tự cấp".

Amazon và Microsoft: Định hình lại mảng điện toán đám mây

Không chịu kém cạnh người hàng xóm Google, Amazon Web Services (AWS) và Microsoft Azure cũng đang tăng tốc bứt phá trên con đường phát triển vi mạch tùy chỉnh quy mô lớn. Tại hạ tầng của Amazon, dòng chip Trainium dành cho tác vụ huấn luyện mô hình và Inferentia dành cho suy luận đã bước sang những thế hệ hoàn thiện nhất, chứng kiến nhu cầu bùng nổ chưa từng có từ phía khách hàng doanh nghiệp. Ban lãnh đạo Amazon tự tin khẳng định mảng kinh doanh chip nội bộ của họ đang đạt tốc độ tăng trưởng doanh thu ở mức ba con số, trở thành một trong những mũi nhọn chiến lược để thuyết phục khách hàng rời bỏ các giải pháp đắt đỏ truyền thống.

Chip AI Trainium do Amazon phát triển. Ảnh: AWS

Đối với tập đoàn Microsoft, sự phụ thuộc vào linh kiện của Nvidia từng là một rào cản lớn khi họ phải gánh vác toàn bộ nền tảng điện toán cho hệ sinh thái Copilot lẫn đối tác chiến lược OpenAI. Sự ra đời của dòng vi mạch tùy chỉnh Maia, cụ thể là các phiên bản Maia 100 và Maia 200, chính là lời giải quyết liệt của tập đoàn cho bài toán chi phí. Mặc dù Microsoft vẫn đang phải chi hàng chục tỉ USD để thâu tóm phần cứng Nvidia nhằm đáp ứng cơn khát tính toán ngắn hạn, việc triển khai song song chip Maia vào hệ thống máy chủ nội bộ giúp họ tiết giảm đáng kể chi phí điện năng và bảo trì cho các tác vụ hàng ngày. Điều này đóng vai trò then chốt trong việc bảo vệ dòng tiền của mảng dịch vụ AI đám mây vốn đang chịu áp lực lớn về cơ sở hạ tầng.

Microsoft Maia 200, một chip tăng tốc A được thiết kế đặc biệt cho mục đích suy luận (inference) trong cơ sở hạ tầng đám mây Azure của Microsoft. Ảnh: Microsoft

Meta MTIA: Lấy quá trình suy luận làm trọng tâm chiến lược

Khác với các đối thủ đám mây, Meta dưới sự lèo lái của Mark Zuckerberg lại sở hữu một cách tiếp cận mang tính thực dụng vô cùng cao đối với phần cứng AI. Với hệ sinh thái mạng xã hội khổng lồ phục vụ hàng tỉ người dùng tương tác mỗi ngày, bài toán lớn nhất của tập đoàn này không chỉ dừng lại ở việc huấn luyện các siêu mô hình nguồn mở Llama. Thử thách thực sự là làm sao để vận hành các thuật toán đề xuất nội dung và chạy suy luận AI với chi phí điện năng lẫn phần cứng rẻ nhất có thể. Dòng vi mạch MTIA (Bộ tăng tốc suy luận đào tạo của Meta) được thai nghén và sinh ra chính xác cho mục đích này.

Chip AI MTIA của Meta. Ảnh: Meta

Hiện tại, các thế hệ MTIA đang được Meta triển khai trên quy mô cực lớn để thay thế dần GPU Nvidia trong hàng loạt trung tâm dữ liệu nội bộ. Các báo cáo phân tích độc lập năm 2026 chỉ ra rằng, chi phí cho quá trình suy luận hiện chiếm đến hai phần ba tổng lượng điện toán AI trên toàn cầu. Việc Meta hợp tác với các nhà gia công như Broadcom để thiết kế vi mạch chuyên biệt giải quyết riêng công đoạn này giúp họ tiết kiệm hàng tỉ USD chi phí mua sắm thiết bị. Hành động này được giới chuyên môn ví như một mũi dao sắc lẹm nhắm thẳng vào thị phần sinh lời nhất của các hãng sản xuất chip đa dụng.

Đế chế GPU của Nvidia có thực sự bị lật đổ?

Dù xu hướng phát triển các vi mạch AI tùy chỉnh từ nhóm Big Tech ngày càng rõ rệt, nhận định về sự suy tàn của Nvidia vẫn còn thiếu cơ sở. Lợi thế cạnh tranh của hãng không chỉ nằm ở sức mạnh phần cứng từ các kiến trúc GPU như Blackwell hay thế hệ Vera Rubin sắp ra mắt, mà còn ở hệ sinh thái phần mềm CUDA - yếu tố tạo nên rào cản gia nhập đáng kể.

Sau hơn hai thập kỷ phát triển, CUDA đã trở thành nền tảng quen thuộc trong cộng đồng trí tuệ nhân tạo với hàng triệu lập trình viên sử dụng. Khả năng tương thích rộng với các framework AI giúp GPU của Nvidia duy trì tính linh hoạt cao trong nghiên cứu và triển khai. Ngược lại, các dòng chip chuyên dụng (ASIC) do các tập đoàn công nghệ lớn phát triển, dù tối ưu về chi phí và hiệu năng cho từng tác vụ cụ thể, lại hạn chế về khả năng mở rộng và chuyển đổi. Việc di chuyển hoặc điều chỉnh phần mềm sang các nền tảng này thường đòi hỏi chi phí kỹ thuật đáng kể.

Trong trung và dài hạn, thị trường phần cứng AI được dự báo sẽ chuyển từ mô hình tập trung sang đa dạng nhà cung cấp. Nvidia nhiều khả năng vẫn giữ vai trò chủ đạo trong huấn luyện mô hình lớn và hạ tầng trung tâm dữ liệu đa dụng - những lĩnh vực đề cao tính linh hoạt. Tuy nhiên, ở mảng triển khai ứng dụng và xử lý suy luận, các giải pháp nội bộ từ Google, Amazon, Microsoft và Meta được kỳ vọng sẽ mở rộng thị phần nhờ khả năng tối ưu hóa theo nhu cầu riêng.

Cạnh tranh gia tăng trong ngành bán dẫn AI được xem là yếu tố thúc đẩy đổi mới. Áp lực thị trường buộc Nvidia tiếp tục cải tiến công nghệ, đồng thời tạo điều kiện để các doanh nghiệp tiếp cận nhiều lựa chọn hạ tầng tính toán với chi phí hợp lý hơn. Trong bối cảnh đó, lợi ích lớn nhất thuộc về sự phát triển nhanh chóng của toàn bộ hệ sinh thái trí tuệ nhân tạo, thay vì tập trung vào một nhà cung cấp duy nhất.

Hoàng Vũ

Nguồn Một Thế Giới : https://1thegioi.vn/google-amazon-microsoft-va-meta-tu-lam-chip-ai-de-che-nvidia-lung-lay-251055.html

Tin khác

Lầu Năm Góc mở rộng hợp tác với 7 công ty AI hàng đầu

một ngày trước

Vì sao Google rót 40 tỉ USD vào đối thủ Anthropic?

5 giờ trước

Cuộc đua xây dựng trung tâm dữ liệu ngoài không gian của các ông lớn công nghệ

7 giờ trước

Huawei và tham vọng thế chân Nvidia trên thị trường chip AI

20 giờ trước

Gemini tiến gần hơn tới trợ lý văn phòng

một ngày trước

Google Cloud vượt mốc doanh thu 20 tỷ đô la

8 giờ trước