Hội nghị GTC của Nvidia sẽ đánh dấu bước ngoặt chip AI: CPU dần trở thành trung tâm

Hiện Nvidia chuẩn bị công bố thông tin chi tiết về các CPU được tối ưu cho agentic AI (AI có tính tự chủ) tại hội nghị thường niên Nvidia GTC khai mạc vào lúc 1 giờ sáng 17.3 giờ Việt Nam, trong đó một rack máy chủ chỉ dùng CPU nhiều khả năng sẽ được trưng bày tại khu triển lãm.

Rack là khung tủ tiêu chuẩn dùng để lắp và sắp xếp các thiết bị máy tính như máy chủ, GPU, thiết bị mạng và hệ thống lưu trữ. Nói đơn giản, rack giống chiếc tủ kim loại cao trong đó xếp nhiều máy chủ lên các tầng để tiết kiệm không gian và dễ quản lý.

“Khi các hệ thống AI và ứng dụng agentic AI mở rộng nhanh chóng, CPU đang dần trở thành điểm nghẽn về hiệu năng”, ông Dion Harris, lãnh đạo mảng hạ tầng AI của Nvidia, nói với hãng tin CNBC và cho rằng đây cũng là “một cơ hội thú vị”.

Nvidia công bố Grace, CPU đầu tiên cho trung tâm dữ liệu của mình, vào năm 2021. Vera, thế hệ CPU tiếp theo của Nvidia, đã bước vào giai đoạn sản xuất. Những CPU này thường được triển khai cùng các GPU nổi tiếng của Nvidia như Hopper, Blackwell hoặc Rubin trong các hệ thống máy chủ hoàn chỉnh ở quy mô rack.

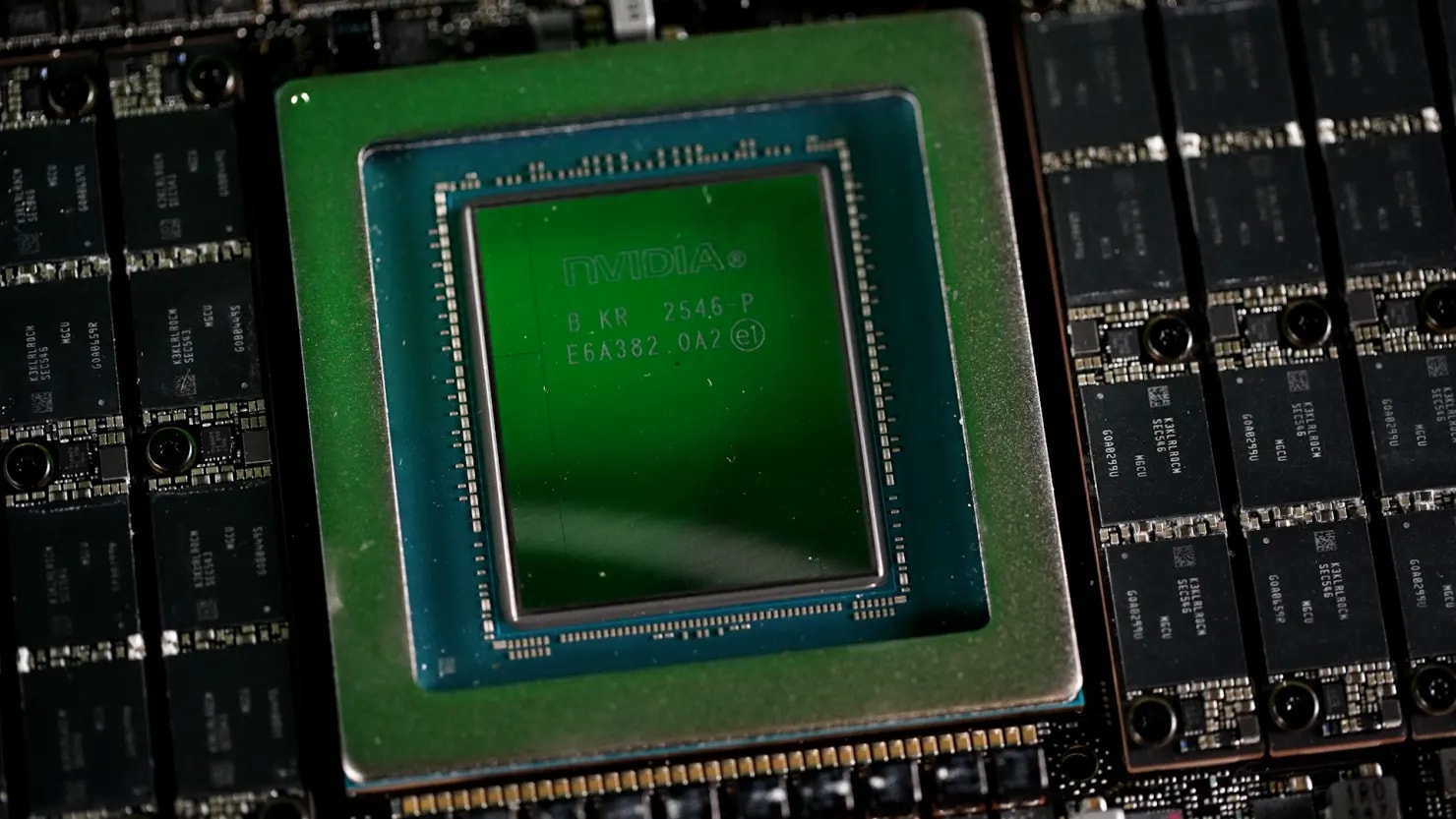

Vera là thế hệ CPU tiếp theo của Nvidia - Ảnh: CNBC

Nhu cầu GPU bùng nổ đã biến Nvidia thành cái tên quen thuộc trong ngành công nghệ và trở thành công ty niêm yết có giá trị nhất thế giới, với vốn hóa khoảng 4.400 tỉ USD. Chiến lược chip rộng hơn của Nvidia đã có bước ngoặt lớn vào tháng 2 khi ký thỏa thuận nhiều năm với Meta. Thỏa thuận này bao gồm việc triển khai CPU Grace ở quy mô lớn dưới dạng độc lập và Vera vào năm 2027.

Hàng nghìn CPU Nvidia độc lập cũng đang giúp vận hành các siêu máy tính tại Trung tâm Tính toán Cao cấp Texas và Phòng thí nghiệm Quốc gia Los Alamos (Mỹ), theo Nvidia.

Ngân hàng Bank of America dự đoán thị trường CPU có thể tăng hơn gấp đôi, từ 27 tỉ USD năm 2025 lên 60 tỉ USD vào 2030. Riêng trong quý 1 năm tài chính 2026, Nvidia đã tạo ra hơn 62 tỉ USD doanh thu từ trung tâm dữ liệu, tăng 75% so với cùng kỳ năm trước.

Sự hồi sinh của CPU được thúc đẩy bởi thay đổi căn bản trong nhu cầu tính toán, khi AI được triển khai rộng rãi chuyển từ các chatbot hỏi-đáp sang ứng dụng agentic AI định hướng nhiệm vụ.

Trong khi GPU lý tưởng để huấn luyện và chạy mô hình AI nhờ hàng nghìn lõi nhỏ có thể xử lý nhiều phép tính song song, thì CPU có ít lõi hơn nhưng mạnh hơn, chuyên xử lý tuần tự các tác vụ tổng quát.

Agentic AI cần rất nhiều sức mạnh tính toán tổng quát vì phải di chuyển lượng dữ liệu khổng lồ giữa các quy trình AI, điều phối hoạt động giữa nhiều tác tử khác nhau.

“Các hệ thống agentic AI này tạo ra nhiều tác tử khác nhau hoạt động như một đội. Số lượng token được tạo ra đã tăng theo cấp số nhân, vì vậy chúng ta cần suy luận với tốc độ cao hơn rất nhiều”, Giám đốc điều hành Jensen Huang của Nvidia nói trong cuộc họp công bố kết quả kinh doanh tháng trước.

Jensen Huang đã nhắc tới agentic AI hơn chục lần trong cuộc họp đó và nói rằng hiệu năng trên mỗi watt điện giờ đây “quan trọng hơn bao giờ hết” khi nhu cầu phần cứng thay đổi.

Trong thông cáo báo chí, Nvidia cho biết các CPU độc lập của hãng mang lại sự cải thiện đáng kể về hiệu năng trên mỗi watt trong các trung tâm dữ liệu của Meta.

“Đây là hạ tầng hoàn toàn mới: Mở rộng các rack CPU mà nhiệm vụ duy nhất là chạy agentic AI. Phần mềm của bạn sẽ chạy ở nơi khác, các bộ tăng tốc như GPU chỉ xử lý token. Song vẫn cần một thành phần trung gian, thường là CPU, để điều phối và kết nối toàn bộ quy trình đó”, Ben Bajarin, nhà phân tích chip của hãng Creative Strategies, nhận định.

“Cuộc khủng hoảng nguồn cung CPU âm thầm”

Thị trường CPU từng khá trầm lắng nay đang đối mặt với điều mà công ty nghiên cứu The Futurum Group gọi là “khủng hoảng nguồn cung âm thầm”. The Futurum Group dự đoán tốc độ tăng trưởng của CPU có thể vượt GPU vào năm 2028.

Các nhà cung cấp CPU lớn như AMD và Intel đã cảnh báo khách hàng tại Trung Quốc về tình trạng thiếu nguồn cung, theo hãng tin Reuters. Thời gian chờ giao CPU hiện có thể lên tới 6 tháng, còn giá đã tăng hơn 10%.

“Mức tăng nhu cầu trong 6 - 9 tháng qua là chưa từng có”, ông Forrest Norrod, lãnh đạo mảng trung tâm dữ liệu của AMD, nói với CNBC.

Forrest Norrod cho biết ông không thấy dấu hiệu nhu cầu sẽ chậm lại, nhưng AMD đã dự đoán được sự tăng trưởng này và đang “nỗ lực đáp ứng”.

Một phát ngôn viên của Intel nói với CNBC rằng tồn kho có thể giảm xuống mức thấp nhất trong quý hiện tại, nhưng công ty đang xử lý mạnh mẽ và kỳ vọng nguồn cung cải thiện từ quý 2/2026.

“Wafer silicon không mọc trên cây và chúng ta không thể đơn giản đi thu hoạch thêm 10% khi cần. Cả ngành đang thiếu hụt, nên wafer silicon cho CPU cũng bị hạn chế”, Ben Bajarin nói.

Wafer silicon là tấm vật liệu bán dẫn rất mỏng được dùng làm nền để chế tạo chip. Trong quá trình sản xuất, các mạch điện tử siêu nhỏ sẽ được khắc và tạo lớp trực tiếp lên bề mặt wafer silicon này. Sau đó, wafer silicon được cắt thành nhiều chip riêng lẻ để lắp vào các sản phẩm như chip nhớ, chip xử lý hay chip AI. Một wafer silicon có thể tạo ra hàng trăm hoặc hàng nghìn chip, tùy kích thước và độ phức tạp của từng loại.

Về việc Nvidia có gặp chậm trễ giao CPU hay không, Dion Harris cho biết: “Cho đến nay mọi thứ vẫn ổn”.

Ông nói chuỗi cung ứng mạnh mẽ của Nvidia đã có thể đáp ứng nhu cầu, phần lớn vì nhiều CPU của hãng được bán kèm GPU trong các hệ thống rack hoàn chỉnh.

“Tối ưu chip rất tốt để phục vụ GPU”

Dion Harris cho biết Nvidia đã áp dụng cách tiếp cận thiết kế hoàn toàn khác, khiến CPU của hãng phù hợp nhất cho xử lý dữ liệu và agentic AI, so với CPU đa dụng của Intel và AMD.

Một khác biệt lớn nằm ở số lượng lõi CPU.

Các dòng CPU máy chủ hiệu năng cao như AMD EPYC và Intel Xeon thường có khoảng 128 lõi, trong khi Grace CPU của Nvidia chỉ có 72 lõi.

“Nếu là hyperscaler (nhà cung cấp dịch vụ điện toán đám mây quy mô lớn), bạn muốn tối đa hóa số lượng lõi trên mỗi CPU. Điều đó về cơ bản sẽ làm giảm chi phí, số USD trên mỗi lõi. Đó là một mô hình kinh doanh”, Dion Harris giải thích.

Thay vào đó, Nvidia đã thiết kế CPU đặc biệt để hỗ trợ các GPU hàng đầu của hãng chạy các tác vụ AI.

“Hiệu năng đơn luồng quan trọng hơn chi phí trên mỗi lõi, bởi các hệ thống phải đảm bảo GPU - tài nguyên rất đắt đỏ - luôn được khai thác tối đa thay vì phải chờ CPU xử lý”, Dion Harris nói thêm.

Nvidia cũng xây dựng CPU của mình trên kiến trúc Arm, vốn thường được dùng cho chip tiết kiệm điện như smartphone. Trong khi Intel và AMD sử dụng kiến trúc x86 truyền thống. Được Intel giới thiệu gần 50 năm trước, x86 đã thống trị thiết kế CPU PC và máy chủ từ đó đến nay.

Forrest Norrod nhận xét Nvidia đã “tối ưu chip rất tốt để phục vụ GPU”, nhưng chúng không tối ưu cho các ứng dụng đa dụng.

Thực tế, Nvidia vẫn dựa vào CPU đa dụng trong một số sản phẩm. Ví dụ, trong nền tảng HGX Rubin NVL8, GPU Nvidia được ghép với CPU từ Intel hoặc AMD để khách hàng xây dựng các rack AI của riêng họ.

HGX Rubin NVL8 là nền tảng máy chủ AI hiệu năng cao do Nvidia thiết kế để xây dựng các hệ thống trung tâm dữ liệu chuyên chạy AI.

Chiến lược “không phụ thuộc nền tảng”

Việc Nvidia tham gia thị trường CPU độc lập diễn ra trong bối cảnh nhiều khách hàng lớn của hãng tự phát triển CPU kiến trúc Arm cho trung tâm dữ liệu.

Amazon là nhà cung cấp dịch vụ điện toán đám mây lớn đầu tiên ra mắt CPU nội bộ với việc phát hành Graviton vào năm 2018. Bộ xử lý Axion của Google, được phát hành vào năm 2024, hiện xử lý khoảng 30% các ứng dụng nội bộ, theo The Futurum Group.

Microsoft đã phát hành bộ xử lý Cobalt thế hệ thứ hai vào tháng 11.2025. Arm dự kiến sẽ ra mắt CPU nội bộ của riêng mình trong năm nay, với Meta là một trong những khách hàng đầu tiên.

Theo hãng nghiên cứu Mercury Research, trong quý 4/2025, Intel thống trị thị phần CPU máy chủ với 60%. Tiếp đó là AMD 24,3% và Nvidia 6,2%. Phần còn lại được chia cho các CPU nội bộ dựa trên kiến trúc Arm của Amazon, Microsoft và Google.

Trước nhu cầu tính toán ngày càng lớn, Nvidia thường có thái độ khá cởi mở với cạnh tranh. Vào tháng 5.2025, Nvidia đã mở công nghệ kết nối NVLink của mình để cấp phép cho các công ty bên thứ ba.

Trong phần còn lại của năm 2025, Nvidia đã ký kết hàng loạt thỏa thuận NVLink với Intel, Qualcomm, Fujitsu và Arm, tạo điều kiện thuận lợi cho việc tích hợp CPU của bên thứ ba với GPU Nvidia trong các máy chủ AI.

Ngoài kiến trúc Arm và x86, Nvidia cũng hỗ trợ RISC-V, kiến trúc mã lệnh mở đang ngày càng phổ biến vì cho phép các công ty thiết kế chip tùy chỉnh mà không phải trả phí bản quyền cho các hãng như Arm.

Tháng 1 vừa qua, Nvidia ký thỏa thuận cho phép công ty chip SiFive (Mỹ) sử dụng NVLink để kết nối các thiết kế chip RISC-V với GPU Nvidia.

Dion Harris cho biết bất kể nhu cầu CPU được đáp ứng bằng cách nào, chiến lược của Nvidia vẫn là “không phụ thuộc nền tảng”.

“Nvidia chắc chắn đang xây dựng CPU dựa trên Arm, nhưng cũng đầu tư sâu vào cộng đồng x86 và toàn bộ hệ sinh thái, nên chúng tôi sẽ có vị thế mạnh theo bất kỳ hướng nào”, ông khẳng định.

Ben Bajarin mô tả chiến lược mới của Nvidia là toàn diện.

Theo Ben Bajarin, để cạnh tranh, Nvidia không thể chỉ bán GPU mà phải mở rộng danh mục sản phẩm sang nhiều loại phần cứng khác nhau, từ GPU, CPU đến các chip chuyên dụng, nhằm đáp ứng ngày càng nhiều dạng khối lượng công việc.

Sơn Vân

Nguồn Một Thế Giới : https://1thegioi.vn/hoi-nghi-gtc-cua-nvidia-se-danh-dau-buoc-ngoat-chip-ai-cpu-dan-tro-thanh-trung-tam-248653.html

Tin khác

Huawei Enjoy 90 Pro Max gây ấn tượng với pin 8.500 mAh và chip Kirin series 8

3 giờ trước

Chỉ mất 60 giây để phá khóa Android vì lỗ hổng bảo mật mới

2 giờ trước

Nhiều người dùng đổi laptop cũ để mua MacBook Neo

2 giờ trước

Xiaomi 18 Pro: Flagship nhỏ gọn gây sốt với chip 2nm và pin 7000 mAh

3 giờ trước

84 công nghệ cao ưu tiên đầu tư: Việt Nam đặt trọng tâm vào AI, bán dẫn và robot

5 giờ trước

Bí mật đằng sau Pokémon Go bại lộ

một giờ trước