Meta hé lộ 4 chip AI riêng sau khi ký hợp đồng bom tấn với Nvidia, AMD

Giống nhiều hãng công nghệ lớn khác như Alphabet (công ty mẹ Google), Amazon và Microsoft, Meta đã đầu tư mạnh vào việc xây dựng đội ngũ thiết kế chip nội bộ, bên cạnh việc mua các sản phẩm có sẵn từ Nvidia và AMD.

Các chip AI mới nằm trong chương trình Meta Training and Inference Accelerator (MTIA) của công ty. Chip đầu tiên trong loạt này có tên MTIA 300, đã được đưa vào sử dụng để vận hành các hệ thống xếp hạng và gợi ý nội dung của Meta.

Ba chip còn lại gồm MTIA 400, MTIA 450, MTIA 500 sẽ được triển khai vào năm 2026 và 2027. Trong đó, MTIA 450 và MTIA 500 được thiết kế để thực hiện suy luận, quá trình mô hình AI phản hồi các câu hỏi và yêu cầu của người dùng.

“Hiện nay, chúng tôi thấy nhu cầu về suy luận đang bùng nổ và đó là lĩnh vực mà chúng tôi đang tập trung”, ông Yee Jiun Song, Phó chủ tịch phụ trách kỹ thuật của Meta, cho biết trong một cuộc phỏng vấn.

Meta đã đạt được một số thành công với các chip phục vụ suy luận, nhưng lại gặp khó khăn với tham vọng lâu dài là phát triển chip để huấn luyện các mô hình ngôn ngữ lớn vận hành các ứng dụng AI.

Bắt đầu từ MTIA 400, Meta đã thiết kế cả một hệ thống hoàn chỉnh xoay quanh các chip này. Hệ thống có kích thước tương đương nhiều giá máy chủ và bao gồm cả một phiên bản làm mát bằng chất lỏng. MTIA 400 đang trên lộ trình được triển khai trong các trung tâm dữ liệu của Meta.

Yee Jiun Song thông báo Meta dự định tung ra các chip AI mới với chu kỳ sáu tháng một lần, do công ty đang nhanh chóng mở rộng số lượng trung tâm dữ liệu để vận hành các ứng dụng như Instagram và Facebook.

“Đó là thực tế về tốc độ mà cơ sở hạ tầng của chúng tôi đang được xây dựng”, Yee Jiun Song nói.

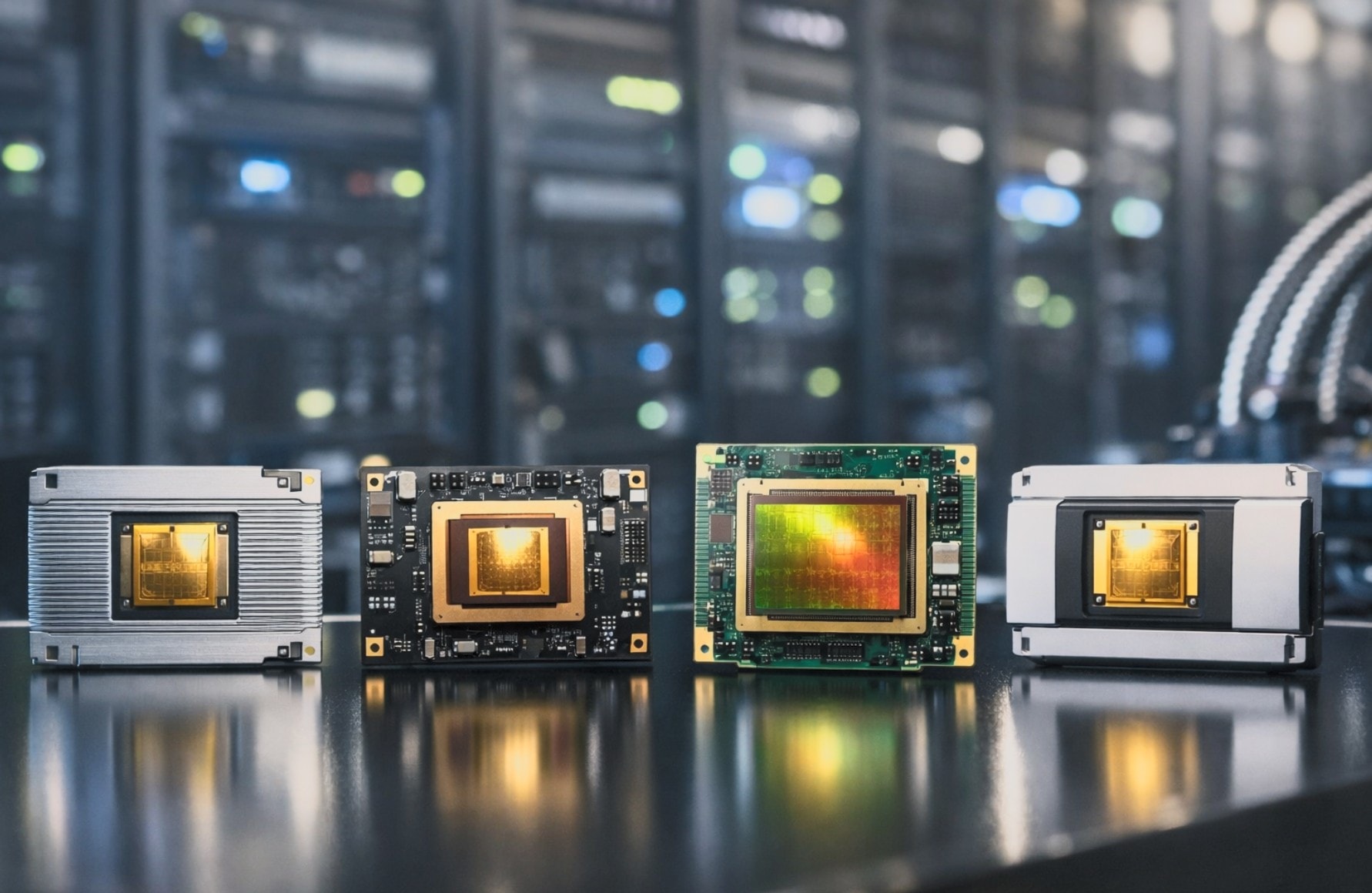

Meta vừa công bố kế hoạch phát triển 4 chip AI tự thiết kế là MTIA 300, MTIA 400, MTIA 450, MTIA 500 - Ảnh: SV

Công ty đã ký hợp đồng với Broadcom để hỗ trợ một số phần trong thiết kế chip, dù Yee Jiun Song không nêu rõ chip nào. Meta sử dụng TSMC để sản xuất các chip này. Tập đoàn TSMC (Đài Loan) là nhà sản xuất chip theo hợp đồng lớn nhất thế giới.

Vào tháng 1, Meta thông báo dự kiến chi tiêu vốn từ 115 tỉ đến 135 tỉ USD trong năm 2026.

Trong tháng 2, Meta đã ký các thỏa thuận bom tấn với Nvidia và AMD để mua lượng chip trị giá hàng chục tỉ USD.

Hôm 24.2, AMD cho biết đã đồng ý bán tới 60 tỉ USD chip AI cho Meta trong 5 năm, một thỏa thuận cho phép công ty mẹ Facebook mua tới 10% cổ phần của hãng chip Mỹ.

AMD sẽ cung cấp cho Meta lượng chip AI tương đương công suất 6 gigawatt, bắt đầu với 1 gigawatt từ sản phẩm chủ lực MI450 sắp ra mắt của công ty vào nửa cuối năm 2026.

Ngoài GPU (bộ xử lý đồ họa) AMD, Meta Platforms có kế hoạch mua CPU (bộ xử lý trung tâm), gồm cả phiên bản được tùy chỉnh theo nhu cầu của gã khổng lồ mạng xã hội này.

Lisa Su, Giám đốc điều hành AMD, cho biết CPU tùy chỉnh sẽ được tối ưu để mang lại hiệu năng mạnh mẽ, đồng thời giữ mức tiêu thụ năng lượng thấp nhất có thể. Thỏa thuận sẽ gồm cả hai thế hệ CPU của AMD.

“Không còn nghi ngờ gì nữa, Mark Zuckerberg có những tham vọng rất lớn về những gì ông ấy muốn đạt được. Chúng tôi muốn sử dụng mọi khía cạnh công nghệ của mình để thực sự giúp Meta đạt được điều đó”, Lisa Su phát biểu, nhắc đến giám đốc điều hành Meta.

Meta đã đóng góp vào thiết kế chip AI MI450, được tối ưu hóa cho quy trình tính toán được gọi là suy luận, tức khi mô hình AI phản hồi các câu hỏi của người dùng.

Các nhà phân tích ngành dự đoán thị trường chip phục vụ quá trình suy luận sẽ lớn hơn nhiều so với thị trường phần cứng dùng để huấn luyện các mô hình AI.

Là một phần của thỏa thuận với Meta, AMD sẽ phát hành chứng quyền mua 160 triệu cổ phiếu với giá thực hiện chỉ là 1 cent (0,01 USD).

Chứng quyền này sẽ được phân bổ dần trong suốt thời gian hợp đồng và sẽ được kích hoạt khi giá cổ phiếu AMD đạt các mục tiêu tăng dần, lên tới 600 USD. Ngoài mục tiêu về giá cổ phiếu, còn có "các yêu cầu kỹ thuật và thương mại" với mỗi đợt phát hành quyền mua cổ phiếu mà cần phải đáp ứng.

“Meta đang đặt cược lớn vào AMD”, Lisa Su nhấn mạnh.

Ngày 17.2, Nvidia thông báo đã ký thỏa thuận kéo dài nhiều năm để bán cho Meta hàng triệu chip AI hiện tại và tương lai, gồm cả CPU cạnh tranh với sản phẩm của AMD và Intel.

Nvidia không tiết lộ giá trị nhưng cho biết thỏa thuận này gồm các GPU Blackwell hiện tại cũng như phiên bản Rubin sắp ra mắt. Thỏa thuận cũng gồm cả việc triển khai độc lập các CPU Grace và Vera của Nvidia.

Nvidia đã giới thiệu các CPU này, dựa trên công nghệ từ Arm Holdings, từ năm 2023 như những sản phẩm bổ trợ cho các chip AI của mình. Tuy nhiên, thông báo trên cho thấy Nvidia đang hướng tới việc mở rộng các CPU này trong những lĩnh vực mới nổi như vận hành tác tử AI, cũng như thâm nhập vào thị trường bộ xử lý dùng cho tác vụ kỹ thuật hàng ngày như vận hành cơ sở dữ liệu.

Tác tử AI là dạng AI có thể quan sát môi trường, đưa ra quyết định và tự hành động để hoàn thành mục tiêu thay người dùng.

Meta có kế hoạch tiếp tục mua chip từ các hãng khác

Santosh Janardhan, Giám đốc hạ tầng Meta, nói công ty vẫn có kế hoạch tiếp tục mua chip từ các nhà cung cấp khác và đồng thời phát triển chip của riêng mình.

Dù Santosh Janardhan không công khai khách hàng là các nhà cung cấp dịch vụ điện toán đám mây quy mô lớn, một số nhà phân tích cho rằng Broadcom là đối tác quan trọng giúp Meta thiết kế và sản xuất ASIC.

ASIC là chip được thiết kế cho một mục đích cụ thể duy nhất, thay vì dùng cho nhiều tác vụ như CPU hay GPU.

Cuối tháng 2, một số trang đưa tin Meta đã ký một thỏa thuận nhiều tỉ USD với Google để thuê các TPU của hãng thông qua Google Cloud, nhằm phục vụ việc huấn luyện các mô hình AI thế hệ mới.

Theo Santosh Janardhan, quy mô xây dựng trung tâm dữ liệu và hạ tầng của Meta lớn đến mức cần nhiều nhà cung cấp chip cùng nhiều cách tiếp cận khác nhau.

"Tất cả nhà sản xuất chip đều có một chỗ đứng nhất định trong cuộc thảo luận với Meta", Santosh Janardhan nhấn mạnh.

TPU là loại chip do Google phát triển từ năm 2015, được thiết kế chuyên phục vụ các tác vụ liên quan đến AI. Nhờ được tối ưu cho một nhiệm vụ, TPU có thể huấn luyện và vận hành các mô hình AI lớn nhanh hơn, hiệu quả hơn và tiết kiệm điện hơn so với nhiều loại chip truyền thống.

Điểm đáng chú ý là Google không còn giữ TPU cho riêng mình. Thông qua dịch vụ đám mây Google Cloud, gã khổng lồ công nghệ Mỹ cho phép các công ty, tổ chức bên ngoài thuê và sử dụng sức mạnh của TPU để phát triển sản phẩm AI. Chính điều này giúp TPU đang trở thành một trong những công nghệ quan trọng cho hạ tầng AI thế hệ mới, có thể cạnh tranh với GPU Nvidia.

Sơn Vân

Nguồn Một Thế Giới : https://1thegioi.vn/meta-he-lo-4-chip-ai-rieng-sau-khi-ky-hop-dong-bom-tan-voi-nvidia-amd-248414.html

Tin khác

Khách 'sộp' của Samsung

3 giờ trước

Microsoft bổ sung thêm gói Office cao cấp

5 giờ trước

Giá laptop có thể tăng tới 40%, người dùng không nên chần chừ

6 giờ trước

Công ty Mỹ doanh thu 25 tỷ USD tê liệt, nghi bị tin tặc Iran tấn công

2 giờ trước

Kiệt sức vì 'trợ lý' AI

10 phút trước

Vì sao tác tử AI bị cấm mua sắm thay người dùng Amazon?

một ngày trước