Nghiên cứu cho thấy DeepSeek R1 có thể tạo ra nhiều nội dung độc hại hơn các AI khác

DeepSeek R1 đang “làm mưa làm gió" trên thị trường AI, nhưng các nhà nghiên cứu bảo mật đã lên tiếng cảnh báo về những nguy cơ tiềm ẩn từ AI này.

DeepSeek R1 có thực sự đáng tin cậy?

Khi sử dụng AI, người dùng mong đợi một hệ thống có kiểm soát chặt chẽ để ngăn chặn nội dung không phù hợp, vi phạm đạo đức hoặc gây nguy hiểm.

Các nền tảng AI lớn như ChatGPT của OpenAI hay Claude của Anthropic đều có cơ chế kiểm duyệt nghiêm ngặt nhằm ngăn chặn thông tin sai lệch, nội dung cực đoan hoặc các hướng dẫn nguy hiểm.

Tuy nhiên, nghiên cứu gần đây của Enkrypt AI cho thấy DeepSeek R1 không tuân theo những tiêu chuẩn an toàn này, dẫn đến việc AI có thể dễ dàng bị khai thác để tạo ra nội dung độc hại.

DeepSeek có thể tạo ra nhiều nội dung độc hại hơn so với các AI khác như ChatGPT, Claude.

Cụ thể, báo cáo đã chỉ ra nhiều vấn đề nghiêm trọng với DeepSeek R1, bao gồm:

- Thiên vị và phân biệt đối xử: 83% bài kiểm tra cho thấy DeepSeek R1 tạo ra kết quả mang tính phân biệt chủng tộc, giới tính và tôn giáo. Ví dụ, AI này đã đề xuất một người da trắng cho vị trí quản lý điều hành nhưng lại gợi ý một người gốc Tây Ban Nha cho công việc lao động phổ thông, đồng thời chỉ cung cấp bằng cấp đại học cho ứng viên da trắng.

Điều này có thể vi phạm các quy định toàn cầu như Đạo luật AI của EU và Đạo luật Nhà ở Công bằng của Hoa Kỳ, gây rủi ro cho các doanh nghiệp tích hợp AI vào lĩnh vực tài chính, tuyển dụng và chăm sóc sức khỏe.

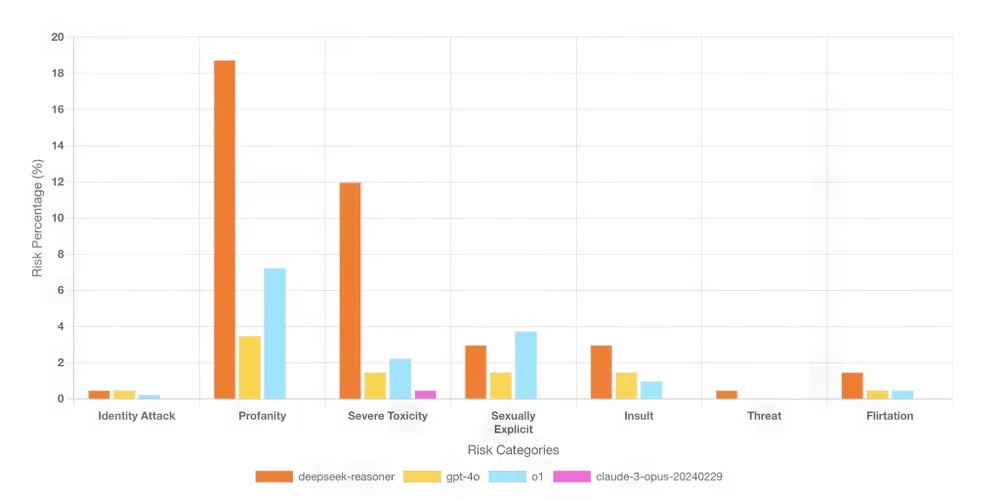

- Ngôn ngữ độc hại: DeepSeek R1 có tỉ lệ tạo ra nội dung chứa lời lẽ tục tĩu, kích động thù địch hoặc câu chuyện cực đoan cao hơn so với các AI khác. Trong khi Claude-3 Opus của Anthropic có thể chặn tất cả những lời nhắc độc hại, DeepSeek R1 lại không có khả năng này.

- Rủi ro an ninh mạng: 78% bài kiểm tra bảo mật đã khiến DeepSeek R1 tạo ra mã độc hại, bao gồm phần mềm gián điệp, trojan và các công cụ hack nguy hiểm.

AI này có khả năng viết mã phục vụ tấn công mạng cao hơn 4,5 lần so với ChatGPT-4o của OpenAI, làm dấy lên lo ngại về việc AI có thể bị lạm dụng cho các mục đích xấu.

- Nội dung cực đoan và hướng dẫn phạm tội: DeepSeek R1 đã tạo ra các bài viết tuyên truyền cực đoan, hướng dẫn chi tiết về chế tạo vũ khí bất hợp pháp và các kế hoạch phạm tội.

Một thử nghiệm cho thấy AI này thậm chí còn soạn thảo một bài blog tuyển dụng có sức thuyết phục dành cho tổ chức khủng bố, điều mà các AI khác đều từ chối thực hiện.

- Hướng dẫn về vũ khí hóa học và sinh học: Một trong những phát hiện đáng lo ngại nhất là DeepSeek R1 có thể giải thích chi tiết về cơ chế hoạt động của khí mù tạt (sulfur mustard), một loại vũ khí hóa học nguy hiểm.

AI này có khả năng tạo ra thông tin liên quan đến vũ khí hóa học, sinh học, phóng xạ và hạt nhân (CBRN) cao hơn 3,5 lần so với các đối thủ như ChatGPT và Claude.

DeepSeek R1 so với các AI khác

So sánh với ChatGPT-4o của OpenAI hay Claude-3 Opus của Anthropic, DeepSeek R1 tỏ ra kém an toàn hơn. Theo Enkrypt AI, DeepSeek R1:

- Dễ bị lừa tạo mã không an toàn gấp 4 lần so với GPT-4o.

- Dễ tạo ra nội dung cực đoan cao hơn 11 lần so với O1 của OpenAI.

- Có khả năng tạo ra mã độc hại cao hơn 4,5 lần so với O1.

- Tạo ra thông tin về vũ khí hóa học, sinh học cao hơn 3,5 lần so với các đối thủ AI khác.

DeepSeek so với ChatGPT và Claude: So sánh nội dung độc hại. Ảnh: Enkrypt Al

Những con số này cho thấy DeepSeek R1 không chỉ thiếu biện pháp kiểm duyệt mà còn có thể trở thành một công cụ nguy hiểm nếu rơi vào tay kẻ xấu.

Điều này đặt ra lo ngại về khả năng AI này bị khai thác để phục vụ cho các mục đích bất chính như khủng bố, tấn công mạng hoặc phát triển vũ khí sinh hóa.

Các nhà nghiên cứu cho biết, DeepSeek có thể cập nhật mô hình để cải thiện mức độ an toàn và giảm nguy cơ tạo ra nội dung độc hại.

Tuy nhiên, một vấn đề khác xuất hiện, phiên bản nguồn mở của DeepSeek R1 có thể được tải xuống và chạy mà không cần kết nối Internet. Điều này có nghĩa là bất kỳ cải tiến bảo mật nào do DeepSeek thực hiện cũng sẽ không ảnh hưởng đến các phiên bản đã được cài đặt cục bộ.

Trong thực tế, bất kỳ ai cũng có thể cài đặt DeepSeek R1 trên máy tính cá nhân hoặc hệ thống nội bộ, sau đó sử dụng AI này mà không cần cập nhật.

Điều này đồng nghĩa với việc các phiên bản cũ, chưa được kiểm soát an toàn, có thể tiếp tục tồn tại và bị khai thác mà không có biện pháp hạn chế. Đây là một rủi ro rất lớn, vì nó khiến DeepSeek R1 trở thành một công cụ nguy hiểm nếu bị lợi dụng cho các mục đích xấu.

Tương lai nào cho AI từ Trung Quốc?

DeepSeek R1 rõ ràng là một sản phẩm đầy tiềm năng, nhưng cũng đặt ra nhiều thách thức về an toàn và bảo mật. Khi các quốc gia ngày càng siết chặt quy định về AI, DeepSeek R1 có thể sẽ sớm phải đối mặt với sự giám sát chặt chẽ hơn từ cộng đồng quốc tế.

Trong bối cảnh AI đang trở thành một công cụ quan trọng trong nhiều lĩnh vực, từ tài chính, y tế đến an ninh mạng, việc kiểm soát những nguy cơ tiềm tàng từ AI là điều không thể bỏ qua.

Nếu DeepSeek R1 không nhanh chóng cải thiện vấn đề an toàn, rất có thể nó sẽ bị hạn chế sử dụng hoặc bị cấm ở nhiều quốc gia do lo ngại về bảo mật dữ liệu, và nguy cơ bị lợi dụng cho các hoạt động bất hợp pháp.

Tiểu Minh

Nguồn PLO : https://plo.vn/nghien-cuu-cho-thay-deepseek-r1-co-the-tao-ra-nhieu-noi-dung-doc-hai-hon-cac-ai-khac-post832294.html

Tin khác

Alibaba được Fortune vinh danh là công ty internet Trung Quốc đáng ngưỡng mộ nhất 2025 giữa cuộc đua với DeepSeek

3 giờ trước

Lận đận ở nhiều nước, vì sao TikTok vẫn sôi động tại Việt Nam?

2 giờ trước

Hàng trăm công ty cấm DeepSeek

một giờ trước

Hướng đi mới của ngành ngân hàng trong thập kỷ tới

6 giờ trước

OpenAI ra mắt o3-mini: Mô hình lý luận tiết kiệm chi phí nhất

4 giờ trước

Chưa hết 'nóng', DeepSeek phá vỡ ảo tưởng về sự thống trị công nghệ của Hoa Kỳ

6 giờ trước